Zawartość

Zawartość

Streszczenie

Część I: Błędna klasyfikacja 2.0: kontrolowana przez algorytm

Studium przypadku nadzoru I: Niepowodzenie w rozpoznawaniu twarzy

Nadzór Studium przypadku II: Kontrole geolokalizacji

Nieprzezroczyste zarządzanie wydajnością

Studium przypadku: Kontrola algorytmiczna

Rozbudowa infrastruktury organów ścigania

Studium przypadku: Udostępnianie danych wywiadowczych organom ścigania

Część II: Wykonywanie praw do danych w pracy: Dostęp

Studia przypadków: Indywidualne DSAR

Niespójne i przyrostowe udostępnianie danych

Studia przypadków: Odpowiedzi platformy na żądania grupowe od WIE

Część III: Wykonywanie praw do danych w pracy: postępowanie sądowe

Kierowcy Uber a Uber I (ogólne prośby o przejrzystość)

Ola drivers przeciwko Ola (ogólne wnioski o przejrzystość)

Kierowcy Uber a Uber II (przejrzystość w zakresie automatycznego podejmowania decyzji)

Odwołania dotyczące licencjonowania w Londynie

Wniosek: dalsza droga do korzystania z praw cyfrowych w pracy?

Streszczenie

Worker Info Exchange została utworzona w celu ułatwienia dostępu i kolektywizacji danych w celu budowania siły przetargowej poprzez ustanowienie zaufania do danych.

Było to odpowiedzią na rozwój nowych algorytmicznych praktyk zarządzania, tworzących głębokie asymetrie informacyjne i wykorzystywanie pracowników.

Worker Info Exchange ma na celu rozwiązanie problemu konwergencji danych i praw pracowniczych, powołując się na prawa art. 15, 20 i 22 RODO w kontekście zatrudnienia.

Cel ten jest poważnie utrudniony przez szeroko rozpowszechnioną niezgodność z RODO w branży koncertowej.

W ciągu ostatnich ośmiu miesięcy zrealizowaliśmy ponad 500 żądań dostępu osób, których dane dotyczą, do siedmiu różnych platform wspólnych przejazdów, w tym Amazon Flex, Bolt, Deliveroo, Free Now, Just Eat, Ola i Uber.

Dostęp do danych jest kwestionowany przez firmy, które wdrażają ciemne wzorce i celowo nadużywają niejednolitego wdrożenia RODO, co zmusza pracowników do rozwiązywania problemów w sądzie.

Gromadzenie danych przez platformy koncertowe jest nadmierne i prowadzi do nieproporcjonalnego i nieodpowiedzialnego nadzoru pracowników, a także do rozbudowy infrastruktury organów ścigania.

Nie ma przejrzystości w zakresie stosowanych algorytmicznych systemów zarządzania. Narracje firmowe o tym, jakie technologie są wykorzystywane i w jaki sposób, są niespójne i niewiarygodne.

© 2021 Wymiana informacji o pracownikach

© 2021 Wymiana informacji o pracownikach

Wstęp

Miniony rok był punktem zwrotnym dla pracowników platform koncertowych w realizacji ich praw pracowniczych i cyfrowych. Praktyka pracy za pośrednictwem mediów cyfrowych doprowadziła do konwergencji praw pracowniczych i praw do ochrony danych, a coraz większa aktywność sądowa i rzecznicza pracowników przynosi rezultaty w tych dziedzinach. W całej Europie sądy wydały kilka ważnych orzeczeń uznających eksploatacyjną rolę praktyk zarządzania algorytmicznego przez platformy koncertowe, potępiając jednocześnie brak uczciwości i przejrzystości w takich zautomatyzowanych systemach.

We Włoszech sąd boloński orzekł, że system oceny Deliveroo dyskryminował pracowników, podczas gdy organ ochrony danych Garante nałożył dwie grzywny RODO na Deliveroo i Glovo z powodu braku odpowiedniego ujawnienia działania ich algorytmów przydzielania zadań i zarządzania wydajnością.

Hiszpania uchwaliła pierwszą ustawę próbującą uregulować sztuczną inteligencję w obszarze zatrudnienia, ustanawiając zarówno status pracownika dla pracowników koncertowych, jak i prawo do otrzymywania informacji o zasadach i parametrach algorytmów, którym podlegają - wyzwalając lawinę skarg. Wynikało to z kolejnej sprawy sądowej przeciwko Glovo, która trafiła do hiszpańskiego Sądu Najwyższego.

Wraz z tymi głośnymi decyzjami, Sąd Najwyższy Wielkiej Brytanii stwierdził również w tym roku, że kierowcy Ubera byli stroną usługi transportowej, która jest „ bardzo ściśle określona i kontrolowana przez Ubera ”, co zdradza wyraźny stosunek pracy, który według firmy nie istniał w jego dążenie do (błędnej) klasyfikacji pracowników jako niezależnych wykonawców. Co istotne, dowody na tę zależność pochodzą z systemów opartych na danych, których używają platformy do wspólnych przejazdów do zarządzania swoimi pracownikami. Niektóre z kwestii wskazanych przez Sąd Najwyższy Wielkiej Brytanii dotyczyły zarządzania kierowcami poprzez algorytmiczne monitorowanie wskaźników przyjęcia pracy, wyboru trasy, stylu jazdy i ocen klientów. Jednak mimo większego uznania zarządzania algorytmicznego, ostatnie zdobycze sądów nie chronią w pełni pracowników przed jego szkodami. Status pracownika (b) nadany kierowcom Ubera w wyniku orzeczenia Sądu Najwyższego jest statusem pośrednika między wykonawcą a pracownikiem i nadal nie chroni ich np. przed niesłusznymi zwolnieniami.

Nasze doświadczenie sugeruje, że te algorytmiczne narzędzia zarządzania, z dodatkiem intensyfikujących praktyk nadzoru, stale kontrolujących pracowników pod kątem potencjalnych oszustw lub wykroczeń, skutkują głębokim wyzyskiem środowiska pracy. W całej branży koncertowej obserwujemy nadmierną liczbę automatycznych zwolnień, z których wiele uważamy za niezgodne z prawem zgodnie z art. 22 ogólnego rozporządzenia o ochronie danych (RODO) . Artykuł 22 zapewnia pracownikom pewną ograniczoną ochronę przed negatywnymi skutkami zautomatyzowanego podejmowania decyzji i profilowania poprzez prawo do uzyskania interwencji człowieka i zakwestionowania decyzji. Artykuł 15 RODO gwarantuje prawo do bycia poinformowanym o istnieniu takiego zautomatyzowanego podejmowania decyzji oraz do otrzymania istotnych informacji o logice przetwarzania.

Opierając się na tych prawach, utworzono Worker Info Exchange z misją wspierania pracowników koncertów w poruszaniu się po tym kompleksie i w regulowanej przestrzeni. Celem i zadaniem naszej pracy jest sprawdzenie, czy te instrumenty RODO mogą być wykorzystane do przeciwdziałania nieuczciwym praktykom zatrudniania i rozszerzenia zakresu danych udostępnianych osobom fizycznym jako pracownikom. Innymi słowy, naszą ambicją jest wykorzystanie dostępu do danych jako metody budowania siły zbiorowego pracownika do testowania mechanizmów dochodzenia roszczeń na cyfrowo zapośredniczonym rynku pracy.

Kiedy stosunek pracy między platformą koncertową a pracownikiem jest realizowany poprzez obszerne gromadzenie i analizę danych, prawa pracownicze stają się nierozerwalnie związane z wykonywaniem praw do danych. Platformy koncertowe zapewniają kontrolę nad pracownikami poprzez zachowanie asymetrii informacyjnej, a dostęp do danych może zapewnić sposób ujawnienia (nie)równowagi mocy generowanej przez lukę informacyjną między platformami koncertowymi a ich pracownikami. Uzyskanie dostępu do danych osobowych może umożliwić pracownikom dokonywanie niezależnych ocen ich warunków pracy i odpowiadanie na pytania dotyczące ich kalkulacji płac, jakości i ilości oferowanej pracy, a także kwestionowanie podstaw niekorzystnego zarządzania wynikami, w tym zawieszenia i zwolnienie.

Naszym celem w ułatwianiu dostępu do danych jest tworzenie zbiorowych magazynów danych w celu lepszego zrozumienia warunków pracy, a co za tym idzie siły przetargowej. W ostatnich latach pojawiło się wiele godnych uwagi inicjatyw, które mają podobne cele, ale wykorzystują różne metodologie wyszukiwania danych. Niektóre projekty w tej dziedzinie prowadzą własne gromadzenie i analizę danych dotyczących zarobków i wyników w celu oceny sprawiedliwych warunków pracy (np . i WeClock, między innymi.) Wszystkie one przedstawiają unikalny wgląd w ekonomię koncertów i powinny być traktowane jako stanowiące kontinuum praktyki danych. Podeszliśmy do tego problemu, żądając, aby platformy udostępniały dane, do których pracownicy są prawnie uprawnieni, jednak wprowadziło to dodatkowe przeszkody dla większego celu, jakim jest kolektywizacja danych. Wybraliśmy tę drogę, ponieważ chcieliśmy ustanowić standardy i precedensy w prawie o ochronie danych, ale także ponieważ uważamy, że istnieją pewne rodzaje informacji, które można uzyskać tylko poprzez żądanie danych bezpośrednio z platform.

Odkryliśmy, zwłaszcza w przypadku podsycanych zarzutów o nielegalną działalność i oszustwa nadzoru, że konieczne jest posiadanie danych przechowywanych przez firmy, aby zrozumieć i zakwestionować oskarżenia. Dostęp do danych może pomóc nam odkryć niespójności w narracjach prezentowanych przez firmy platformowe i pomóc przenieść ciężar dowodu z pracowników z powrotem na platformy. Z tej perspektywy dążenie do uzyskania danych z platformy okazało się niezwykle skuteczne w rozwiązywaniu wielu sporów pracowniczych. Prosta demonstracja odmowy udostępnienia danych osobowych przez platformy spowodowała cofnięcie kilku przypadków cofnięcia licencji (wymuszonych przez TfL) w sądzie, a tym samym stała się dodatkowym narzędziem w wykonywaniu praw pracowniczych.

Stanowi to drugą gałąź działalności dla Worker Info Exchange; ponieważ jesteśmy sfrustrowani naszymi próbami uzyskania jasności i przejrzystości złożonych systemów określających warunki pracy, często musimy uciekać się do sporów sądowych i zwracać się do sądów o decyzje w pojawiającym się obszarze cyfrowych praw pracowniczych. Sztuczny „kryzys danych”, który stworzyły platformy koncertowe, jest pod wieloma względami próbą wyczerpania i uszczuplenia zasobów niestałych pracowników i związków poprzez wciąganie sporów do sądów, gdzie mogą się one przedłużać, a odpowiedzialność za wykroczenia korporacyjne opóźniać.

Zgodnie z tymi nurtami działalności, niniejszy raport składa się z trzech części: Pierwsza część bada różne aspekty zarządzania algorytmicznego i jego szkód, wraz z powiązanymi studiami przypadków. Druga sekcja dotyczy naszego procesu wykorzystywania wniosków o dostęp do danych (DSAR), podczas gdy trzecia zawiera przegląd spraw związanych z RODO, które podjęliśmy w Amsterdamie, a także spraw licencyjnych, które obsługujemy w Londynie. Niniejszy raport zamyka okres prac nad tymi funkcjami naszej organizacji, realizowanych przy wsparciu Fundacji Mozilla, Digital Freedom Fund i Open Society Foundations. Mamy nadzieję, że ten raport wykaże obecny stan rzeczy w korzystaniu z praw na przecięciu danych i pracy oraz ujawni skumulowane skutki powtarzających się niezgodności ze strony platform koncertowych.

„Firmy platformowe działają w bezprawnej przestrzeni, w której wierzą, że mogą ustalać zasady. Niestety to nie jest gra; rzeczywistość wirtualna ma surowe konsekwencje dla pracowników koncertowych w prawdziwym życiu. Zachęcające jest to, że sami pracownicy nie czekają na przepisy, decydenci, a nawet sojusznicy w ruchu praw człowieka, aby ich ratować. Giganci organizują się i używają wspólnego głosu, aby domagać się nowych zabezpieczeń, które są odpowiednie do celów w gospodarce cyfrowej.

Bama Athreya, członek Fundacji Społeczeństwa Otwartego

Część I: Błędna klasyfikacja 2.0 Kontrolowane przez algorytm

W trwającej sześć lat batalii o prawa pracownicze w brytyjskiej gospodarce koncertowej Uber twierdził, że był jedynie agentem samozatrudnionego kierowcy, który nie robił nic poza biernym rezerwowaniem zleceń i pobieraniem płatności. Aby rozwinąć tę fikcję, platformy koncertowe zawarły skomplikowane umowy, które sprawiają, że wydaje się, że kierowca i pasażer prowadzą ze sobą bezpośrednią transakcję, podczas gdy w rzeczywistości wszystkie informacje dla pasażerów są ściśle chronione przez firmy. Na przykład Uber generuje fikcyjną fakturę w imieniu kierowcy na każdego przewożonego pasażera. Faktura będzie zawierać tylko imię pasażera i nigdy nie jest faktycznie wysyłana do klienta.

Te techniki błędnej klasyfikacji, powszechnie stosowane w całej gospodarce koncertowej, umożliwiają platformom unikanie obowiązków prawnych pracodawcy, takich jak ochrona podstawowych praw pracowniczych i składki na ubezpieczenie społeczne. W Wielkiej Brytanii umożliwiło to również firmom zajmującym się platformami uniknięcie podatku od wartości dodanej (VAT). Jednak na początku tego roku Sąd Najwyższy potwierdził prawo sądów niższej instancji do odrzucenia sztucznych umów i ustalenia prawdziwego charakteru stosunku pracy na podstawie dowodów na istnienie stosunku zarządczego polegającego na kontroli nad pracownikami.

Ponieważ firmy zajmujące się platformami dochodzą do wniosku, że stosowanie wprowadzających w błąd umów nie jest już opłacalne jako metoda błędnej klasyfikacji zatrudnienia, będą kuszone, aby podwoić automatyzację procesów w celu ukrycia kontroli zarządczej. Kontrola algorytmiczna staje się błędną klasyfikacją 2.0. Rzeczywiście, istnieje wiele dowodów na to, że to już się dzieje. Platformy koncertowe są bardziej niż kiedykolwiek zdeterminowane, aby realizować strategie błędnej klasyfikacji, aby mogły nadal kontrolować siłę roboczą, jednocześnie unikając ryzyka, że kierowcy mogą przejść ze statusu „pracownika” z ograniczonymi prawami do statusu pracownika ze znacznie większymi prawami.

Czym więc jest kontrola algorytmiczna i jakie są szczególne zagrożenia dla pracowników koncertowych? W szczególności w branżach wspólnych przejazdów i dostawczych, najważniejsze dla nas metody zarządzania algorytmicznego obejmują:

Nadzór. Nadzór inwazyjny w podanym celu zabezpieczenia i identyfikacji. Obejmuje to wykorzystanie technologii wykrywania oszustw i rozpoznawania twarzy. Zdajemy sobie sprawę, że nadzór jest prowadzony nawet wtedy, gdy pracownik nie zalogował się, aby stać się dostępnym do pracy. Obejmował również monitorowanie korzystania przez pracownika z aplikacji jako konsumenta.

Zarządzanie wydajnością. Obejmuje to między innymi monitorowanie stylu jazdy, w tym ETA, oceny klientów, wskaźniki akceptacji i ukończenia pracy, interakcję z personelem pomocniczym, dostępność.

Przydział pracy. Uber do niedawna nalegał, aby przydział pracy decydował o bliskości kierowców i pasażerów, ale teraz przyznaje, że uwzględniane są wcześniejsze zachowania i preferencje. Ola przyznaje, że profile kierowców, które obejmują „profil zarobków” i „prawdopodobieństwo oszustwa” są wykorzystywane w zautomatyzowanym podejmowaniu decyzji dotyczących alokacji pracy.

Cennik. Ściśle związane z alokacją pracy jest zautomatyzowane podejmowanie decyzji cenowych. Być może najbardziej znaną metodą jest tak zwana „wzrost” lub „dynamiczna wycena” firmy Uber, która ma na celu eliminację popytu rynkowego z lokalnymi wahaniami cen w czasie rzeczywistym.

Powyższe decyzje zarządcze są w większości zautomatyzowane lub półautomatyczne z ograniczoną interwencją człowieka. Modele biznesowe gospodarki koncertowej opierają się na masowej automatyzacji decyzji zarządczych i nadzorze w miejscu pracy. Podczas gdy niektórzy pracodawcy są powściągliwi w tej kwestii, Deliveroo dość otwarcie o tym mówi w swojej polityce prywatności dla kierowców :

„Biorąc pod uwagę ilość dostaw, którymi się zajmujemy, używamy zautomatyzowanych systemów do podejmowania zautomatyzowanych decyzji opisanych powyżej, ponieważ zapewniają one dokładniejszy, uczciwszy i skuteczniejszy sposób identyfikacji podejrzanych oszustw, zapobiegając powtarzającym się naruszeniom umowy z dostawcą i ograniczając negatywny wpływ na nasze usługi. Kontrole ludzi po prostu nie byłyby możliwe w ramach czasowych i biorąc pod uwagę ilość dostaw, którymi się zajmujemy”.

Zarządzanie wydajnością

Obejmuje to między innymi monitorowanie stylu jazdy, w tym ETA, oceny klientów, wskaźniki akceptacji i ukończenia pracy, interakcję z personelem pomocniczym, dostępność.

cennik

Ściśle związane z alokacją pracy jest zautomatyzowane podejmowanie decyzji cenowych. Być może najbardziej znaną metodą jest tak zwana „wzrost” lub „dynamiczna wycena” Ubera, która ma na celu wygładzenie popytu rynkowego z lokalnymi wahaniami cen w czasie rzeczywistym.

Nadzór

Nadzór inwazyjny w podanym celu bezpieczeństwa i identyfikacji. Obejmuje to wykorzystanie technologii wykrywania oszustw i rozpoznawania twarzy. Zdajemy sobie sprawę, że nadzór jest prowadzony nawet wtedy, gdy pracownik nie zalogował się, aby stać się dostępnym do pracy. Obejmował również monitorowanie korzystania przez pracownika z aplikacji jako konsumenta.

Przydział pracy

Uber do niedawna nalegał, aby przydział pracy był decydowany o bliskości kierowców i pasażerów, ale teraz przyznaje, że uwzględniane są wcześniejsze zachowania i preferencje. Ola przyznaje, że profile kierowców, które obejmują „profil zarobków” i „prawdopodobieństwo oszustwa” są wykorzystywane w zautomatyzowanym podejmowaniu decyzji dotyczących alokacji pracy.

Część I: Błędna klasyfikacja 2.0 Kontrolowane przez algorytm

W trwającej sześć lat batalii o prawa pracownicze w brytyjskiej gospodarce koncertowej Uber twierdził, że był jedynie agentem samozatrudnionego kierowcy, który nie robił nic poza biernym rezerwowaniem zleceń i pobieraniem płatności. Aby rozwinąć tę fikcję, platformy koncertowe zawarły skomplikowane umowy, które sprawiają, że wydaje się, że kierowca i pasażer prowadzą ze sobą bezpośrednią transakcję, podczas gdy w rzeczywistości wszystkie informacje dla pasażerów są ściśle chronione przez firmy. Na przykład Uber generuje fikcyjną fakturę w imieniu kierowcy na każdego przewożonego pasażera. Faktura będzie zawierać tylko imię pasażera i nigdy nie jest faktycznie wysyłana do klienta.

Te techniki błędnej klasyfikacji, powszechnie stosowane w całej gospodarce koncertowej, umożliwiają platformom unikanie obowiązków prawnych pracodawcy, takich jak ochrona podstawowych praw pracowniczych i składki na ubezpieczenie społeczne. W Wielkiej Brytanii umożliwiło to również firmom zajmującym się platformami uniknięcie podatku od wartości dodanej (VAT). Jednak na początku tego roku Sąd Najwyższy potwierdził prawo sądów niższej instancji do odrzucenia sztucznych umów i ustalenia prawdziwego charakteru stosunku pracy na podstawie dowodów na istnienie stosunku zarządczego polegającego na kontroli nad pracownikami.

Ponieważ firmy zajmujące się platformami dochodzą do wniosku, że stosowanie wprowadzających w błąd umów nie jest już opłacalne jako metoda błędnej klasyfikacji zatrudnienia, będą kuszone, aby podwoić automatyzację procesów w celu ukrycia kontroli zarządczej. Kontrola algorytmiczna staje się błędną klasyfikacją 2.0. Rzeczywiście, istnieje wiele dowodów na to, że to już się dzieje. Platformy koncertowe są bardziej niż kiedykolwiek zdeterminowane, aby realizować strategie błędnej klasyfikacji, aby mogły nadal kontrolować siłę roboczą, jednocześnie unikając ryzyka, że kierowcy mogą przejść ze statusu „pracownika” z ograniczonymi prawami do statusu pracownika ze znacznie większymi prawami.

Czym więc jest kontrola algorytmiczna i jakie są szczególne zagrożenia dla pracowników koncertowych? W szczególności w branżach wspólnych przejazdów i dostawczych, najważniejsze dla nas metody zarządzania algorytmicznego obejmują:

Nadzór. Nadzór inwazyjny w podanym celu zabezpieczenia i identyfikacji. Obejmuje to wykorzystanie technologii wykrywania oszustw i rozpoznawania twarzy. Zdajemy sobie sprawę, że nadzór jest prowadzony nawet wtedy, gdy pracownik nie zalogował się, aby stać się dostępnym do pracy. Obejmował również monitorowanie korzystania przez pracownika z aplikacji jako konsumenta.

Zarządzanie wydajnością. Obejmuje to między innymi monitorowanie stylu jazdy, w tym ETA, oceny klientów, wskaźniki akceptacji i ukończenia pracy, interakcję z personelem pomocniczym, dostępność.

Przydział pracy. Uber do niedawna nalegał, aby przydział pracy decydował o bliskości kierowców i pasażerów, ale teraz przyznaje, że uwzględniane są wcześniejsze zachowania i preferencje. Ola przyznaje, że profile kierowców, które obejmują „profil zarobków” i „prawdopodobieństwo oszustwa” są wykorzystywane w zautomatyzowanym podejmowaniu decyzji dotyczących alokacji pracy.

Cennik. Ściśle związane z alokacją pracy jest zautomatyzowane podejmowanie decyzji cenowych. Być może najbardziej znaną metodą jest tak zwana „wzrost” lub „dynamiczna wycena” firmy Uber, która ma na celu eliminację popytu rynkowego z lokalnymi wahaniami cen w czasie rzeczywistym.

Powyższe decyzje zarządcze są w większości zautomatyzowane lub półautomatyczne z ograniczoną interwencją człowieka. Modele biznesowe gospodarki koncertowej opierają się na masowej automatyzacji decyzji zarządczych i nadzorze w miejscu pracy. Podczas gdy niektórzy pracodawcy są powściągliwi w tej kwestii, Deliveroo dość otwarcie o tym mówi w swojej polityce prywatności dla kierowców :

„Biorąc pod uwagę ilość dostaw, którymi się zajmujemy, używamy zautomatyzowanych systemów do podejmowania zautomatyzowanych decyzji opisanych powyżej, ponieważ zapewniają one dokładniejszy, uczciwszy i skuteczniejszy sposób identyfikacji podejrzanych oszustw, zapobiegając powtarzającym się naruszeniom umowy z dostawcą i ograniczając negatywny wpływ na nasze usługi. Kontrole ludzi po prostu nie byłyby możliwe w ramach czasowych i biorąc pod uwagę ilość dostaw, którymi się zajmujemy”.

„Biorąc pod uwagę ilość dostaw, którymi się zajmujemy, używamy zautomatyzowanych systemów do podejmowania zautomatyzowanych decyzji opisanych powyżej, ponieważ zapewniają one dokładniejszy, uczciwszy i skuteczniejszy sposób identyfikacji podejrzeń o oszustwo, zapobiegając powtarzającym się naruszeniom umowy z dostawcą i ograniczając negatywny wpływ na nasze usługi. Kontrole ludzi po prostu nie byłyby możliwe w ramach czasowych i biorąc pod uwagę ilość dostaw, którymi się zajmujemy”.

Nadzór

Nadzór inwazyjny w podanym celu bezpieczeństwa i identyfikacji. Obejmuje to wykorzystanie technologii wykrywania oszustw i rozpoznawania twarzy. Zdajemy sobie sprawę, że nadzór jest prowadzony nawet wtedy, gdy pracownik nie zalogował się, aby stać się dostępnym do pracy. Obejmuje również monitorowanie korzystania z aplikacji przez pracownika jako konsumenta.

Przydział pracy

Uber do niedawna nalegał, aby przydział pracy był ustalany na podstawie bliskości kierowców i pasażerów, ale teraz twierdzi, że uwzględniane są wcześniejsze zachowania i preferencje. Ola wykorzystuje profile kierowców, które obejmują „oceny prawdopodobieństwa oszustwa” w automatycznym podejmowaniu decyzji dotyczących pracy przydział.

Zarządzanie wydajnością

Ocena wyników pracy obejmuje między innymi monitorowanie stylu jazdy, w tym ETA, oceny klientów, wskaźniki akceptacji i ukończenia pracy, interakcję z personelem pomocniczym, dostępność.

cennik

Ściśle związane z alokacją pracy jest automatyczne ustalanie ceny. Być może najbardziej znaną metodą jest tak zwana „wzrost” lub „dynamiczna wycena” Ubera, która ma na celu eliminację popytu rynkowego z lokalnymi wahaniami cen w czasie rzeczywistym.

Inwigilacyjny wyścig zbrojeń

Obserwujemy wyścig zbrojeń nadzoru w gospodarce koncertowej, odkąd Uber wprowadził w 2020 r. swój tak zwany hybrydowy system identyfikacji w czasie rzeczywistym. Zaledwie dzień przed ogłoszeniem przez Transport for London (TfL) decyzji o odmowie odnowienia licencji w listopadzie 2019 r. Uber zaproponował wprowadzenie tego systemu nadzoru, który obejmuje rozpoznawanie twarzy z monitorowaniem GPS.

Była to odpowiedź na skargę TfL, że wykryto 21 kierowców (spośród 90 000 analizowanych w ciągu kilku lat) jako zaangażowanych w udostępnianie kont, co pozwoliło potencjalnie nielicencjonowanym i nieubezpieczonym kierowcom na nielegalne oferowanie swoich usług w aplikacji. Czynność była możliwa dzięki zresetowaniu lokalizacji GPS urządzenia tak, jak poza granicami Wielkiej Brytanii, gdzie kierowcy mogą wgrywać własne zdjęcia. Lukę tę szybko wypełnił Uber, a wykryta aktywność była znikomo mała w porównaniu ze skalą działania Ubera. Wprowadzenie przez branżę technologii rozpoznawania twarzy było całkowicie nieproporcjonalne w stosunku do postrzeganego ryzyka. Niemniej jednak wymóg identyfikacji w czasie rzeczywistym stał się warunkiem odnowienia licencji Ubera w Westminster Magistrates Court we wrześniu 2020 r.

W przypadku Ubera zarówno kierownictwo platformy, jak i TfL nie zapewniły odpowiednich zabezpieczeń w celu ochrony praw i wolności kierowców, mimo że TfL dokonała przeglądu oceny wpływu tej technologii na ochronę danych w marcu 2020 roku. wolność żądania informacji do TfL w celu uzyskania dostępu do DPIA firmy Uber dla systemów identyfikacji w czasie rzeczywistym, ale odmówiono nam. Według raportów TfL , 94% kierowców prywatnych pojazdów do wynajęcia (PHV) pochodzi z mniejszości etnicznych i czarnoskórych, a wprowadzenie tej technologii, która jest dobrze znana ze względu na niskie wskaźniki dokładności w tych grupach , okazała się katastrofalna dla pracowników znajdujących się w trudnej sytuacji niepewne zatrudnienie.

Bolt od tego czasu ogłosił , że inwestuje 150 milionów euro w systemy wykrywania oszustw związanych ze sztuczną inteligencją, w tym rozpoznawanie twarzy. Deliveroo ogłosiło, że oni również wprowadzą kontrolę tożsamości z rozpoznawaniem twarzy. Ola Cabs wprowadziła również identyfikację rozpoznawania twarzy jako funkcję swojego systemu Guardian , obejmującą uczenie maszynowe, które, jak twierdzą, umożliwia im „ciągłe uczenie się i ewolucję z milionów punktów danych każdego dnia, w celu poprawy sygnalizacji ryzyka i natychmiastowej rozdzielczości”.

FreeNow, spółka joint venture Daimlera i BMW, również ściśle monitoruje kierowców w ramach ich programu zapobiegania oszustwom. Rzeczywiście, dokumenty złożone przez FreeNow do Sądu Najwyższego w ramach przeglądu sądowego decyzji TfL o przyznaniu im prawa jazdy w Londynie, ujawniły, że TfL sporządzała comiesięczne raporty o zwolnieniach kierowców z różnych powodów (w tym „nieuczciwej działalności”), jako warunek ich ostatnie odnowienie licencji. Jednak opis danych przetwarzanych w celu zapobiegania oszustwom rodzi więcej pytań, niż znajduje się w polityce prywatności FreeNow.

W tym dokumencie Free Now stwierdza, że używa algorytmu „losowego lasu”, aby uzyskać wynik oszustwa, którego używają do „odpowiedniego ustalenia priorytetów wysłanych podróży. Zapewnia to uczciwą wysyłkę i zminimalizowane ryzyko .” Free Now zakwestionowało korzystanie przez nich z tego systemu wykrywania oszustw, gdy zapytaliśmy o to w czerwcu 2021 r., twierdząc, że ta sekcja polityki prywatności jest nieaktualna (patrz studium przypadku firmy w sekcji II raportu). Jednak opis tego systemu pozostał w polisie, pomimo aktualizacji dokonanej we wrześniu 2021 r.

Szczególnie niepokojące w korzystaniu z tych systemów jest to, że łączą one zarządzanie oszustwami z zarządzaniem wydajnością. Fakt, że takie wskaźniki „oszustwa” są wykorzystywane jako zmienne do alokacji pracy i że zachowania, które je generują, mogą być kontynuowane na platformie, pokazuje, że nie są to przypadki oszustw kryminalnych, ale mechanizmy kontroli, które oceniają, jak dobrze radzą sobie pracownicy w stosunku do nieprzejrzystych wskaźników ustalonych przez firmy. Sugerujemy, aby każda terminologia „oszustwa” używana w tych kontekstach również funkcjonowała jako część gry w błędną klasyfikację, mającą na celu ukrycie stosunku pracy.

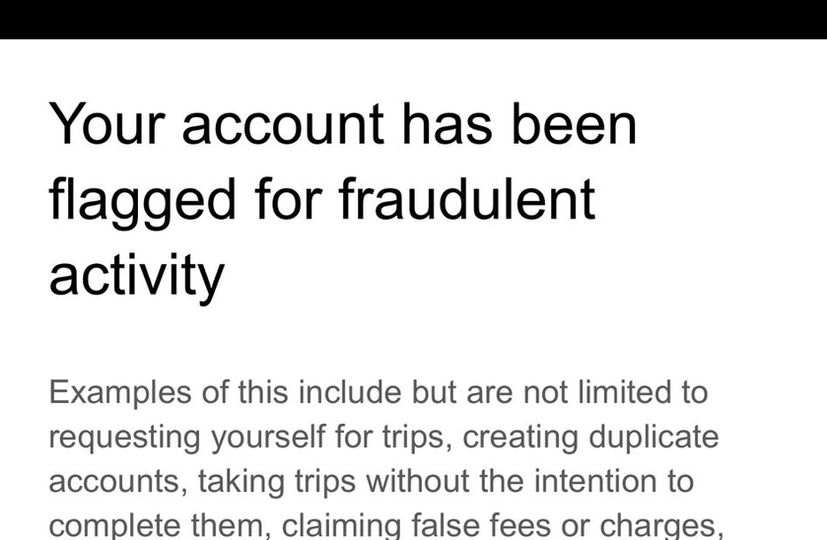

Studium przypadku nadzoru I: Niepowodzenie w rozpoznawaniu twarzy

W kwietniu 2020 r. Uber wprowadził w Wielkiej Brytanii system sprawdzania tożsamości w czasie rzeczywistym (RTID), który wykorzystuje kombinację, w tym rozpoznawanie twarzy i sprawdzanie lokalizacji, w celu uwierzytelnienia tożsamości kierowcy i uniemożliwienia kierowcy współdzielenia dostępu do swojego konta w celu pracy.

System RTID wykorzystuje Microsoft FACE API, oprogramowanie do rozpoznawania twarzy i wymaga od kierowców i kurierów rutynowego robienia sobie selfie w czasie rzeczywistym, aby móc dalej korzystać z aplikacji Uber. Zdjęcie jest następnie porównywane ze zdjęciem profilowym na koncie kierowcy (oraz w niektórych jurysdykcjach z publicznymi bazami danych, aby „ zapobiegać pożyczaniu tożsamości lub zweryfikować tożsamość użytkowników ”).

Pa Edrissa Manjang pracował z Uberem przez około rok, kiedy został dezaktywowany z powodu niepowodzenia weryfikacji selfie. Chociaż kierowcy i kurierzy Ubera rutynowo dostarczają selfie, nie są one przechowywane w telefonach pracowników i nie mogą oni zachować dowodów swoich oświadczeń. Tata nie otrzymał żadnych ostrzeżeń ani nie został powiadomiony o żadnych problemach, dopóki nie został zwolniony; system weryfikacji tożsamości w czasie rzeczywistym wydawał się zatwierdzać wszystkie jego zdjęcia za pomocą zielonego czeku.

Po zwolnieniu tata wysłał wiele wiadomości do Ubera, aby rozwiązać problem, w szczególności prosząc człowieka o sprawdzenie jego zgłoszeń. Za każdym razem, gdy tata słyszał, że „nie byliśmy w stanie potwierdzić, że dostarczone zdjęcia rzeczywiście przedstawiały Ciebie, a z powodu ciągłych niedopasowań podjęliśmy ostateczną decyzję o zakończeniu naszej współpracy z Tobą”. Otrzymaliśmy przedmiotowe selfie za pomocą prośby o dostęp do tematu, która ujawniła, że wszystkie zdjęcia przesłane przez Pa w rzeczywistości były jego. To był pierwszy przypadek, w którym udało nam się uzyskać selfie przesłane przez kuriera lub kierowcę. Nie jest jasne, dlaczego ta prośba się powiodła, skoro wielu przed nią zawiodło.

Na początku tego roku napisaliśmy również do firmy Microsoft, aby wyrazić nasze obawy dotyczące nieuregulowanego korzystania przez Ubera z interfejsu API FACE na jego platformie. W odpowiedzi Microsoft podkreślił, że wszystkie strony zaangażowane we wdrażanie takich technologii mają obowiązki, które obejmują: „wprowadzanie istotnej oceny ludzkiej w celu wykrywania i rozwiązywania przypadków błędnej identyfikacji lub innych awarii” oraz „aby zapewnić wsparcie osobom, które uważają, że ich wyniki były nieprawidłowe; oraz aby zidentyfikować i rozwiązać fluktuacje dokładności spowodowane zmiennością warunków”. Przypadek Pa wyraźnie pokazuje, że te kluczowe kontrole nie zostały zaimplementowane w przetwarzaniu obrazów RTID.

Pa wnosi teraz sprawę przeciwko Uberowi, aby zakwestionować jego dyskryminujące rasowo wdrożenie rozpoznawania twarzy, reprezentowane przez Bates Wells, przy wsparciu Komisji ds. Równości i Praw Człowieka, App Drivers and Couriers Union oraz Worker Info Exchange.

UMIEŚĆ: Wideo Pa

Nadzór Studium przypadku II: Kontrole geolokalizacji

Chociaż korzystanie z wadliwych systemów rozpoznawania twarzy jest niewątpliwie problematyczne, zauważyliśmy również, że wielu kierowców zostało zwolnionych po fałszywych oskarżeniach ze strony Ubera, że brali udział w nieuczciwym udostępnianiu kont po wykryciu przez Ubera dwóch urządzeń w dwóch lokalizacjach jednocześnie. We wszystkich przypadkach, które przeanalizowaliśmy, stwierdziliśmy, że problem dotyczy tego, że kierowca zainstalował aplikację na dwóch urządzeniach dla wygody, ale tylko na jednym z nich jest zalogowany do pracy.

Tuż przed 20:00 11 września 2020 r. Aweso Mowlana pracował dla Ubera w południowym Londynie. Był kierowcą z oceną 4,95 gwiazdki, który odbył ponad 11 500 przejazdów w ciągu 5 lat pracy dla Ubera. Aweso właśnie wysadził pasażera w pobliżu Elephant and Castle, kiedy wylogował się na krótką przerwę. Podobnie jak wielu kierowców, Aweso zainstalowało aplikację na drugim urządzeniu, którym był iPhone. Tego wieczoru zostawił iPhone'a w domu i pracował ze swoim drugim telefonem, Samsungiem.

O 20:02 Aweso próbował ponownie zalogować się do aplikacji Uber, aby być dostępnym do następnej pracy. Zanim pozwolono mu się ponownie zalogować, został poproszony o wykonanie selfie w ramach kontroli tożsamości w czasie rzeczywistym (RTID) Ubera. Jego zdjęcie pasowało do zdjęcia referencyjnego Ubera, więc pomyślnie zakończył procedurę wykupu, aby kontynuować swoją zmianę. Ale nie wiedział, że systemy Ubera wykryły i/lub pingowały jego drugi telefon. Jego syn przez pomyłkę odebrał drugi telefon i zabrał go ze sobą do domu swojej dziewczyny w Uxbridge. Uber później powiedział, że zażądali sprawdzenia RTID z tego urządzenia o 20:03, ale do tego czasu Aweso było już online w południowym Londynie. Uber twierdzi, że odpowiedź na sprawdzenie tożsamości została wysłana z iPhone'a około 23:55 tego wieczoru.

Następnego dnia Uber poinformował go, że jego konto zostało „oznaczone z powodu podejrzanej aktywności aplikacji” i że jego konto zostanie teraz zawieszone na czas „sprawdzania tego przez wyspecjalizowany zespół”. Jakiś czas później Uber na stałe zwolnił Aweso w wiadomości SMS, informując, że „znaleźli dowody wskazujące na nieuczciwą działalność” na jego koncie. Uber następnie zarzucił, że dzielił się dostępem do swojego konta i w ten sposób naruszył regulamin. W następnym miesiącu Transport for London natychmiast cofnął licencję Aweso na tej podstawie, że nie można już było uznać go za „odpowiedniego i właściwego” do posiadania licencji publicznej ze względu na jego zwolnienie z Ubera.

Worker Info Exchange pomogła Aweso w złożeniu wniosku o dostęp do tematu i analizie otrzymanych danych. Jeden plik o nazwie „ Szczegółowe dane urządzenia D river” rejestruje przynajmniej część danych przesyłanych strumieniowo z urządzeń do Ubera w czasie rzeczywistym. Polityka prywatności firmy Uber wskazuje, że gdy urządzenie ma otwartą aplikację w tle lub na pierwszym planie, nawet jeśli nie jest online i jest gotowa do przyjmowania opłat. W kilkunastu przypadkach, w których poparliśmy kierowanie odwołaniem się od unieważnienia prawa jazdy w sądzie pokoju, każde odwołanie zostało uwzględnione, a TfL nakazano przywrócić prawa jazdy. Z tego pliku mogliśmy zobaczyć aż 230 wierszy danych na minutę rejestrowanych przez Ubera z urządzeń. Uwzględniono dane zebrane przez Ubera z urządzeń Aweso geolokalizacja, poziom baterii, prędkość, kurs, numer IMEI itp.

Dane wykazały, że urządzenie w Uxbridge nigdy nie było zalogowane do pracy tego dnia, ponieważ pole zatytułowane „driver_online” wyświetlało iPhone'a jako „FALSE” przez cały czas tego dnia, łącznie z godziną nagrania w Uxbridge. Jest to dowód na to, że urządzenie nie było udostępniane do pracy z innymi, jak twierdzą Uber i Transport for London. Uber nie zapewnił dostępu do danych osobowych przetwarzanych w obu kontrolach RTID, w tym do zebranych zdjęć. „Szczegółowe dane urządzenia” nie pokazują żadnej dalszej aktywności iPhone'a po 20:03:43. Nie widzieliśmy żadnych danych świadczących o aktywności urządzenia o 23:55, kiedy Uber powiedział, że otrzymał odpowiedź na wcześniej wydaną kontrolę tożsamości.

Doświadczenie Pa i Aweso było bardzo rozpowszechnione w ciągu ostatniego roku i stanowiło znaczną część spraw prowadzonych przez Worker Info Exchange i App Drivers & Couriers Union. W Londynie Transport for London miał tendencję do natychmiastowego cofania praw jazdy kierowcom, którzy nie przeszli kontroli RTID Ubera, pomimo oczywistych problemów z systemem. Często istnieją rozsądne wyjaśnienia dotyczące używania wielu urządzeń, które są automatycznie klasyfikowane jako oszustwo. Polityka prywatności firmy Uber wskazuje, że gdy urządzenie ma otwartą aplikację w tle lub na pierwszym planie, nawet jeśli nie jest online i jest gotowa do przyjmowania opłat. W kilkunastu przypadkach, w których poparliśmy kierowanie odwołaniem się od unieważnienia prawa jazdy w sądzie pokoju, każde odwołanie zostało uwzględnione, a TfL nakazano przywrócić prawa jazdy.

Worker Info Exchange, Big Brother Watch i App Drivers & Couriers Union napisali wspólny list do burmistrza Londynu, aby wyrazić nasze obawy dotyczące tego, że Transport for London opiera się na wadliwych dowodach od Ubera przy podejmowaniu decyzji o cofnięciu i zażądali tego jako przewodniczący Transportu dla zarządu Londynu, aby zarządził przegląd wszystkich takich bezprawnych odwołań. Do tej pory ani burmistrz, ani TfL nie udzielili odpowiedzi.

Nieprzezroczyste zarządzanie wydajnością

Nieprzezroczystość firm zajmujących się platformami uniemożliwia pracownikom zrozumienie, w jaki sposób kontrola algorytmiczna może zostać zintegrowana w zakresie krytycznych procesów i w czasie. Na przykład pracownikom nie zapewniono przejrzystości, do której mają prawo, aby zrozumieć, w jaki sposób profilowanie wydajności wiąże się z jakością i ilością oferowanej pracy, a także z oczekiwanymi zyskami za taką pracę.

W przypadku Ola mamy pewną wiedzę na temat kategorii danych, które zbierają i przetwarzają w swoich systemach alokacji pracy - takich jak między innymi ocena prawdopodobieństwa oszustwa, profil zarobkowy, historia akceptacji i anulowania rezerwacji - jednak nie ujawnia to różnych wag zastosowane do tych zmiennych, ani logika przetwarzania.

Uber od dawna utrzymywał, że jego system dopasowywania zależy wyłącznie od lokalizacji, mimo że jego własny interfejs „Partner-Kierowca” sugeruje inaczej. Program Uber's Pro (do którego kierowcy są automatycznie zapisani, aby mogli być zachęcani do osiągania celów wydajnościowych w zamian za korzyści i nagrody) informuje kierowców w niejasnym języku, że „wyższy wskaźnik potwierdzeń oznacza krótszy czas oczekiwania dla klientów i krótszy czas odbioru dla wszystkich kierowców” luźno nawiązując do faktu, że spadająca liczba miejsc pracy będzie skutkować mniejszą liczbą ofert pracy.

Uber dopiero niedawno zaoferował większą przejrzystość systemu dopasowywania poprzez aktualizację ich polityki prywatności, która stwierdza: „Użytkownicy mogą być dopasowywani na podstawie dostępności, bliskości i innych czynników, takich jak prawdopodobieństwo zaakceptowania podróży w oparciu o ich wcześniejsze zachowanie lub preferencje” ale w chwili pisania tego tekstu łącze oferujące dalsze informacje na temat systemu dopasowywania jest uszkodzone, co świadczy o ewoluującym charakterze takiego przetwarzania danych. Niedawna prośba o wolność informacji, którą skierowaliśmy do TfL, pytając, jakie aktualizacje dostarczył Uber w swoim systemie dopasowywania (do czego jest zobowiązany przy wprowadzaniu zmian w swoim modelu operacyjnym), nie przyniosła żadnych wyników, co jeszcze bardziej uwydatniło zaciemnianie jego algorytmicznych praktyk zarządzania oraz brak nadzoru regulacyjnego.

Ostatnie rewelacje na temat zmiennych determinujących przydział pracy rodzą również ważne pytania o jakość pracy oferowanej kierowcom. Czy kierowcy o wysokim wskaźniku akceptacji pracy oferują podróże o dłuższym czasie trwania i czasie trwania, skutkujące wyższymi zarobkami, na podstawie podobnego profilowania? A może, idąc o krok dalej, czy kierowcy oferują różne stawki w dynamicznym systemie cenowym? Rzeczywiście, to, czy i jak algorytmiczne ustalanie cen łączy się z alokacją pracy, jest delikatną kwestią, o której wciąż niewiele wiadomo.

W ostatnich latach Uber zastąpił klientom zmienne ceny według czasu i odległości modelem stałych cen, w którym cena z góry jest akceptowana na początku podróży. Uber twierdzi, że „cena z góry jest dynamiczna, co oznacza, że cena jest ustalana w czasie rzeczywistym, aby pomóc zrównoważyć podaż i popyt”. Niedawno kierowcy zgłaszali, że oferowane są im bardzo niskie stawki za poszczególne prace. Istnieje oczywista okazja dla Ubera, aby zwiększyć swój udział w ostatecznej taryfie płaconej przez pasażerów. Pojawiły się obawy dotyczące dyskryminujących skutków stosowania tych dynamicznych systemów ustalania cen dla pasażerów, co stwarza perspektywę, że kierowcy mogą również podlegać spersonalizowanym cenom w czasie rzeczywistym. Istnieją poważne problemy etyczne, jeśli operatorzy oferują niższe ceny wrażliwym pracownikom w oparciu o profilowanie, które przewiduje ich gotowość do przyjęcia pracy w różnych punktach cenowych.

W Wielkiej Brytanii takie praktyki wydają się być sprzeczne z postanowieniami sekcji 1 ustawy o prawach pracowniczych, która uprawnia pracowników do otrzymywania od pracodawcy jasnego określenia warunków ich pracy, w tym stawek wynagrodzenia.

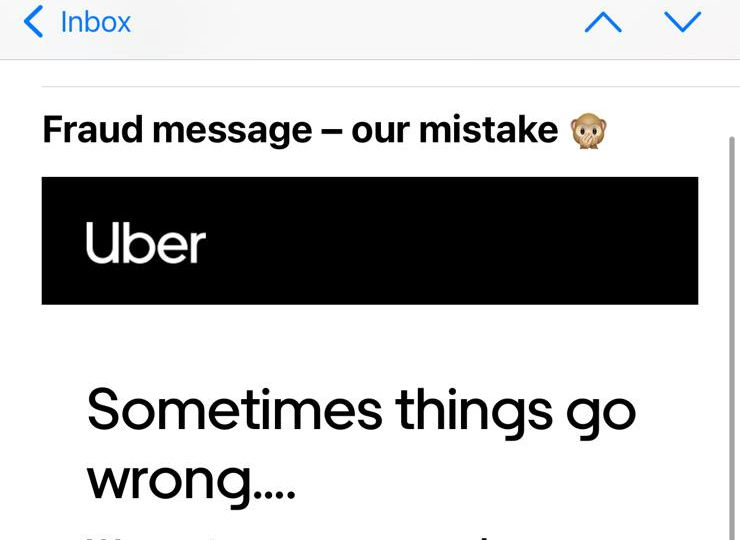

Studium przypadku: Kontrola algorytmiczna

Uber rutynowo wysyła wiadomości do kierowców, gdy są oflagowani przez swoje systemy wykrywania oszustw, aby ostrzec ich, że mogą stracić pracę, jeśli będą kontynuować jakiekolwiek zachowanie, które uruchamia system. Komunikaty zawierają niewyczerpującą listę potencjalnych wyzwalaczy, ale nie podają przyczyny specyficznej dla konkretnego kierowcy, który jest oskarżony o oszustwo. Kiedy Alexandru otrzymał drugą i ostatnią z tych wiadomości, wiedząc, że inna flaga spowoduje zwolnienie, postanowił zadzwonić do zespołu wsparcia kierowców, aby uzyskać dalsze informacje o tym, dlaczego uruchomił system przeciwdziałania oszustwom i co mógł zrobić, aby go uniknąć . W rozmowie telefonicznej Alexandru i agent wsparcia omówili różne sytuacje, które mogły spowodować, że jego podróże wydawały się nieregularne, ujawniając ograniczone możliwości zespołów wsparcia w rozszyfrowywaniu wskazówek systemu. Trzy miesiące po tej rozmowie Uber wysłał wiadomość z przeprosinami, w której stwierdził, że wysłano mu ostrzeżenia przez pomyłkę.

Podczas gdy rozmowa jest pouczająca, jeśli chodzi o zrozumienie dylematów, z jakimi borykają się kierowcy, gdy polityka firmy i wymagania pasażerów rozchodzą się, szczególnie zainteresowała nas dyskusja (25 minut rozmowy) dotycząca objazdu, który Alexandru obrał z powodu robót drogowych, a także jego niskiego wskaźniki akceptacji pracy jako potencjalne przyczyny jego wykrycia przez system antyfraudowy. Po orzeczeniu Sądu Najwyższego, który zakwalifikował kierowców Ubera jako pracowników na początku tego roku, Uber twierdził, że dokonał znaczących zmian na swojej platformie, takich jak zapewnienie przejrzystości cen i miejsca docelowego, a także zniesienie środków karnych za odmowę pracy, starając się argumentować, że wyrok Sądu Najwyższego nie dotyczył obecnych kierowców Ubera.

Doświadczenie Alexandru z platformą jest sprzeczne z tą narracją, ponieważ staje się jasne, że prawdopodobnie jest on oflagowany za zboczenie z trasy (pomimo faktu, że Uber ma teraz model stałej ceny, co oznacza, że kierowcy dokonują takich zmian trasy na własny koszt) i nie akceptowanie wystarczającej ilości pracy oferowanej mu na platformie. To wezwanie niezaprzeczalnie wyjaśnia, że w praktyce kierowcy nadal są tak samo ściśle kontrolowani przez Ubera, jak wcześniej.

Oprócz tych praktyk zarządczych, wspomniany powyżej program Pro jest kolejnym narzędziem, którego Uber wykorzystuje do sprawowania kontroli nad swoimi pracownikami, przy jednoczesnym uchylaniu się od obowiązków prawnych, które mogą być związane z taką kontrolą. Na przykład, wiążąc określone nagrody, których kulminacją jest utrzymanie wysokiej oceny z firmami zewnętrznymi lub prezentując udział w korzyściach cenowych jako czysto opcjonalny poprzez zachęcanie behawioralne, Uber stwarza iluzję, że kierowcy mogą działać z całkowitą niezależnością i elastycznością. Rzekome dobrowolne zaangażowanie kierowców w te programy skutkuje zrzeczeniem się praw wynikających ze stosunku pracy.

EMBED: wideo Alexandru

Rozbudowa infrastruktury organów ścigania

Istnieją również dowody na to, że platformy stają się coraz bardziej atrakcyjnym źródłem danych wywiadowczych dla policji i służb bezpieczeństwa. W zeznaniu świadka przedstawionym jako dowód we wrześniu 2020 r. w apelacji Ubera w sprawie licencji w Westminster Magistrates Court, dyrektor generalny Ubera z Wielkiej Brytanii i Europy Zachodniej, Jamie Heywood, potwierdził coraz bliższe relacje z policją i służbami bezpieczeństwa. Należą do nich National Counter Terrorism Policing Network, SO15 - Dowództwo Antyterrorystyczne Metropolitan Police Service, National Police Chiefs Council (NPCC), College of Policing, National Crime Agency i brytyjska policja transportowa. Jednym z obszarów współpracy był problem transportu narkotyków tzw. liniami powiatowymi. Cytując inspektora detektywa Stuarta Liddella z NPCC, Heywood zeznał o dojrzewaniu związku opartego na wyrafinowanych poziomach wymiany informacji wywiadowczych:

„Zachęca mnie zaangażowanie Ubera w tę sprawę i planowane są dalsze prace [w 2020 r.], aby oprzeć się na dotychczasowych pracach. Skoncentruje się to na bardziej skomplikowanych aspektach linii hrabstwa, przepływie informacji i danych wywiadowczych oraz wzmocnieniu relacji między krajowym centrum koordynacji linii hrabstwa.

Rzeczywiście, NPCC lobbowało na rzecz londyńskiego komisarza Mike'a Browna, aby poparł apelację Ubera o licencję. Naczelny posterunkowy Mark Collins posunął się nawet do zasugerowania, że decyzja o odmowie licencji Uberowi może mieć negatywny wpływ na brytyjską policję.

„Mam nadzieję, że ten list przedstawia negatywny wpływ na policję w Wielkiej Brytanii, jeśli policja nie będzie mogła uzyskać dostępu do danych i informacji, które opisałem”.

Heywood zeznał również, że Collins twierdził, że sama Metropolitan Police Service każdego roku wysyła do Ubera ponad 2000 próśb o dane. Jest to stosunkowo duża liczba wniosków, biorąc pod uwagę, że według własnego Raportu przejrzystości Ubera, w 2020 r. wszystkie organy ścigania w USA łącznie złożyły prawie 5000 wniosków o udostępnienie danych, a wszystkie kanadyjskie organy ścigania łącznie złożyły zaledwie 411 takich wniosków.

Jest prawdopodobne, że kierownictwo Ubera odczuwa presję, aby współpracować z inicjatywami zbierania danych wywiadowczych przez policję, szczególnie w świetle decyzji Transport for London o dwukrotnym odmowie odnowienia licencji. Dzieje się tak, ponieważ sekcja 17 ustawy o przestępczości i zaburzeniach z 1998 r. nakłada bezpośrednią odpowiedzialność na władze wydające licencje za zapobieganie przestępczości i zamieszki na ich obszarze. Nakłada to na organy wydające licencje, takie jak Transport for London, wymóg ustanowienia partnerstwa na rzecz redukcji przestępczości i zaburzeń (CDRP), w których mają uczestniczyć operatorzy transportowi, tacy jak Uber.

W ustawowych wytycznych Departamentu Transportu dla organów wydających licencje rząd wzmacnia oczekiwanie na wymianę informacji wywiadowczych między policją, organami wydającymi zezwolenia i operatorami transportowymi, takimi jak Uber:

„Zwiększanie świadomości wśród sił policyjnych o organach wydających licencje wartościowe, jakie przypisują otrzymywanym informacjom, w szczególności informacji wywiadowczych o braku wyroków skazujących, pomoże w rozwijaniu tych relacji i wzmocni korzyści płynące z większego dzielenia się informacjami. Ta relacja może być korzystna dla obu stron, pomagając policji w zapobieganiu przestępczości. Policja może pozyskać cenne informacje od kierowców i operatorów...”

Chociaż takie relacje mają duże znaczenie dla kontroli przestępczości na poziomie społeczności, wydaje się, że niewiele uwagi poświęcono ryzyku dla swobód obywatelskich związanych ze stosunkowo łatwym dostępem do bogatych danych osobowych kierowców i pasażerów gromadzonych i przechowywanych przez platformy takie jak Uber, Bolt i Ola Kabiny.

„Zachęca mnie zaangażowanie Ubera w tę sprawę i planowane są dalsze prace [w 2020 r.], aby oprzeć się na dotychczasowych pracach. Skoncentruje się to na bardziej skomplikowanych aspektach linii hrabstwa, przepływie informacji i danych wywiadowczych oraz wzmocnieniu relacji między krajowym centrum koordynacji linii hrabstwa.

„Mam nadzieję, że ten list przedstawia negatywny wpływ na policję w Wielkiej Brytanii, jeśli policja nie będzie mogła uzyskać dostępu do danych i informacji, które opisałem”.

„Zwiększanie świadomości wśród sił policyjnych o organach wydających licencje wartościowe, jakie przypisują otrzymywanym informacjom, w szczególności informacji wywiadowczych o braku wyroków skazujących, pomoże w rozwijaniu tych relacji i wzmocni korzyści płynące z większego dzielenia się informacjami. Ta relacja może być korzystna dla obu stron, pomagając policji w zapobieganiu przestępczości. Policja może uzyskać cenne informacje od kierowców i operatorów...”

Studium przypadku: Udostępnianie danych wywiadowczych organom ścigania

Innym pracownikiem, który zwrócił się do nas o pomoc, był kierowca Ubera, który został niesłusznie zawieszony na platformie Ubera na siedem tygodni, ponosząc stratę w wysokości prawie 5000 funtów na żądanie policji. W 2019 roku kierowca otrzymał wiadomość od Ubera, że został tymczasowo zawieszony z powodu toczącego się śledztwa. Nie podano mu powodu ani terminu zawieszenia. W rzeczywistości wyraźnie powiedziano mu, aby nie kontaktował się z Uberem podczas prowadzenia dochodzenia. Siedem tygodni później otrzymał telefon z informacją, że może teraz pracować.

Dwa lata później, wniosek o odnowienie licencji, który kierowca złożył do TfL (obejmujący rozszerzoną kontrolę usługi Disclosure and Barring Service) ujawnił przyczynę zawieszenia, gdy TfL zapytał go o dostarczanie leków w 2019 roku i zagroził odebraniem mu prawa jazdy. Zszokowany rewelacją kierowca zażądał numeru referencyjnego przestępstwa i przeprowadził dalsze dochodzenie nie tylko z TfL, ale także z Metropolitan Police.

Pomogliśmy kierowcy w składaniu wniosków o dostęp i skarg do Ubera, TfL i policji. Uber nie spełnił prośby (kierowca został poinformowany, że jego prośba została przekazana zespołowi specjalistów, ale nie otrzymał dalszej odpowiedzi), jednak odpowiedź TfL ujawniła obszerny łańcuch wiadomości e-mail między różnymi urzędnikami, którzy próbowali zidentyfikować źródło informacji wywiadowczych wniosek. Uber twierdził, że podeszła do nich policja, podczas gdy policja nie znalazła żadnych zapisów ani dowodów na przeprowadzenie dochodzenia w sprawie kierowcy. Ostatecznie Uber wymienił funkcjonariusza, który złożył wniosek do wywiadu, ale kiedy TfL szukał szczegółów w sprawie, OIC stwierdził, że nie pamięta danego kierowcy.

Na skargę, którą kierowca skierował do Metropolitan Police, ostatecznie udzielono odpowiedzi w październiku 2021 r. i stwierdzono, że kierowca nigdy nie został zidentyfikowany jako podejrzany:

„Funkcjonariusze mieli za zadanie zidentyfikować podejrzanego w związku z poważnym przestępstwem. Funkcjonariuszom podano nazwisko osoby interesującej. Mogę potwierdzić, że to NIE byłaś ty. W dniu 20 lutego 2019 r. do Ubera przesłano formularz dotyczący ochrony danych zawierający wymienione dane podejrzanego. Nie mogę ujawnić żadnych dalszych szczegółów na ten temat.

„Na żadnym etapie Twoje imię i nazwisko nie pojawiło się w tym badaniu przeprowadzonym z Uberem. Funkcjonariusz NIE zwrócił się do Ubera w poszukiwaniu jakichkolwiek powiązanych z Tobą informacji. W wyniku naszego zapytania Uber udostępnił policji Twoje dane. Po otrzymaniu informacji od Ubera, który podał nam Twoje imię i nazwisko, wiedzieliśmy, że NIE jesteś powiązany z naszym dochodzeniem, nie podjęto żadnych dalszych działań i zostałeś wykluczony z dalszych dochodzeń”.

„Funkcjonariusz nie naruszył żadnych standardów zawodowych ani nie działał poza swoją rolą funkcjonariusza policji ani nie nadużył swoich uprawnień. Twoje imię i nazwisko nie było celem prośby i w żadnym momencie nie powiedzieliśmy Uberowi, że jesteś osobą zainteresowaną.

„Uber powinien być może wyjaśnić, w jaki sposób zawiesił osobę, która nie była przedmiotem pierwotnego wniosku, a także dlaczego po 10 dniach nie zostałeś automatycznie przywrócony do aplikacji i nie możesz kontynuować pracy”.

UMIEŚĆ: Wideo L

„Funkcjonariusze mieli za zadanie zidentyfikować podejrzanego w związku z poważnym przestępstwem. Funkcjonariuszom podano nazwisko osoby interesującej. Mogę potwierdzić, że to NIE byłaś ty. W dniu 20 lutego 2019 r. do Ubera przesłano formularz dotyczący ochrony danych zawierający wymienione dane podejrzanego. Nie mogę ujawnić żadnych dalszych szczegółów na ten temat.

„Na żadnym etapie Twoje imię i nazwisko nie pojawiło się w tym badaniu przeprowadzonym z Uberem. Funkcjonariusz NIE zwrócił się do Ubera w poszukiwaniu jakichkolwiek powiązanych z Tobą informacji. W wyniku naszego zapytania Uber udostępnił policji Twoje dane. Po otrzymaniu informacji od Ubera, który podał nam Twoje imię i nazwisko, wiedzieliśmy, że NIE jesteś powiązany z naszym dochodzeniem, nie podjęto żadnych dalszych działań i zostałeś wykluczony z dalszych dochodzeń”.

„Funkcjonariusz nie naruszył żadnych standardów zawodowych ani nie działał poza swoją rolą funkcjonariusza policji ani nie nadużył swoich uprawnień. Twoje imię i nazwisko nie było celem prośby i w żadnym momencie nie powiedzieliśmy Uberowi, że jesteś osobą zainteresowaną.

„Uber powinien być może wyjaśnić, w jaki sposób zawiesił osobę, która nie była przedmiotem pierwotnego wniosku, a także dlaczego po 10 dniach nie zostałeś automatycznie przywrócony do aplikacji i nie możesz kontynuować pracy”.

Część II: Wykonywanie praw do danych w pracy: Dostęp

Prawo pracy nie zawiera niezbędnych przepisów, aby w pełni chronić pracowników przed nieuczciwymi praktykami wynikającymi z zarządzania algorytmicznego. Jednak osoby fizyczne mają prawa wynikające z RODO, które mogą chronić ich interesy w kontekście zatrudnienia. Wspierając pracowników, powołujemy się na ich prawa określone w art. 15, 20 i 22, które dają im prawo dostępu do danych osobowych , prawo do przenoszenia danych , a także prawo do bycia informowanym o zautomatyzowanym podejmowaniu decyzji i logice przetwarzania .

Artykuł 22: Osoby, których dane dotyczą, nie mogą podlegać decyzjom o skutkach prawnych (lub podobnie istotnych), opartych wyłącznie na zautomatyzowanym przetwarzaniu danych.

[Jeżeli administrator danych przetwarza dane za wyraźną zgodą osoby, której dane dotyczą, lub w celu wykonania zawartej z nią umowy, osoba, której dane dotyczą, ma prawo do uzyskania interwencji ludzkiej, wyrażenia swojego punktu widzenia, a także do zakwestionowania decyzji]

Artykuł 15: Osoby, których dane dotyczą, mają prawo do otrzymania kopii swoich danych osobowych, wraz z dodatkowymi informacjami, takimi jak cele przetwarzania danych, informacje o tym, komu dane mogą być udostępniane, czas przetwarzania itp.

Artykuł 20: Osoby, których dane dotyczą, mają prawo do otrzymania danych osobowych, które dostarczyły administratorowi, w ustrukturyzowanym, powszechnie używanym formacie nadającym się do odczytu maszynowego. Mają również prawo do przesłania („przeniesienia”) danych innemu administratorowi. W miarę możliwości mogą poprosić o przekazanie danych bezpośrednio od jednego administratora do drugiego.

Chociaż platformy udostępniają pracownikom pobieranie danych, często pomijają one kategorie danych najbardziej sprzyjające i niezbędne do badania warunków pracy (takie jak sprawiedliwość wynagrodzenia, przydział i wykorzystanie pracy, jak wymieniono powyżej). W naszym dążeniu do rozszerzenia zakresu dane udostępniane pracownikom, składamy konkretne wnioski o dostęp i przenoszenie danych, które obejmują pełen zakres platform koncertowych gromadzonych od nich. W tych żądaniach staramy się uzyskać trzy różne rodzaje danych:

1) Dane wejściowe – dostarczane przez samych pracowników

2) Dane z obserwacji – na podstawie korzystania z platform przez pracowników (tj. surowe dane pomiarowe i nadzoru, takie jak dane o lokalizacji, telematyka itp.)

3) Dane wnioskowane – pochodzące z analizy danych z obserwacji (np. profilowanie zachowań pracowników w postaci oceny ryzyka i nadużyć)

Artykuł 22: Osoby, których dane dotyczą, nie mogą podlegać decyzjom o skutkach prawnych (lub podobnie istotnych), opartych wyłącznie na zautomatyzowanym przetwarzaniu danych.

[Jeżeli administrator danych przetwarza dane za wyraźną zgodą osoby, której dane dotyczą, lub w celu wykonania zawartej z nią umowy, osoba, której dane dotyczą, ma prawo do uzyskania interwencji ludzkiej, wyrażenia swojego punktu widzenia, a także do zakwestionowania decyzji]

Artykuł 15: Osoby, których dane dotyczą, mają prawo do otrzymania kopii swoich danych osobowych wraz z dodatkowymi informacjami, takimi jak cele przetwarzania danych, informacje o tym, komu dane mogą być udostępniane, czas trwania przetwarzania itp.

Artykuł 20 : Osoby, których dane dotyczą, mają prawo do otrzymania danych osobowych, które dostarczyły administratorowi, w ustrukturyzowanym, powszechnie używanym formacie nadającym się do odczytu maszynowego. Mają również prawo do przesłania („przeniesienia”) danych innemu administratorowi. W miarę możliwości mogą poprosić o przekazanie danych bezpośrednio od jednego administratora do drugiego.

Dane wejściowe

Dostarczone przez samych pracowników

Zaobserwowane dane

Na podstawie wykorzystania platform przez pracowników (tj. surowe dane pomiarowe i nadzoru, takie jak dane o lokalizacji, telematyka itp.)

Wywnioskowane dane

Pochodzące z analizy danych z obserwacji (np. profilowanie zachowań pracowników w formie oceny ryzyka i oszustw)

Te kategorie danych są często wyraźnie określone w wytycznych i politykach prywatności, ale nie są udostępniane kierowcom, gdy pobierają oni swoje dane lub składają wnioski o dostęp do danych. Z naszego doświadczenia wynika, że gdy pracownicy szukają tych informacji, platformy koncertowe mają na celu utrudnienie i uciążliwość procesu poprzez angażowanie się w różne niezgodne z przepisami zachowania. Pracownicy poszukujący kompleksowych danych muszą poruszać się po wyjątkowo złożonych i przeszkadzających architekturach witryn internetowych i muszą omijać dalsze wysiłki agentów pomocy technicznej, którzy niepotrzebnie przedłużają proste procesy administracyjne lub zapewniają automatyczne odpowiedzi, które nie są w stanie odpowiednio odpowiedzieć na zapytania. Procedury te można opisać jako „ ciemne wzorce” mające na celu odprowadzenie pracowników od korzystania z ich praw jako osób, których dane dotyczą. W sytuacjach, gdy pracownicy są w stanie uzyskać swoje dane, często brakuje w nich znacznych segmentów lub są one prezentowane w niespójnych i nieczytelnych dla maszyn formatach, co skutecznie uniemożliwia analizę. Te akty obstrukcji zmuszają pracowników do powtarzania próśb, które firmy ostatecznie wykorzystują jako powód do ich zdyskredytowania.

We wszystkich zeznaniach DSAR, które widzieliśmy, żaden pracodawca nie podał pełnego i właściwego opisu zautomatyzowanego przetwarzania danych osobowych. Jest to szczególnie ważne w obszarach, które mogą decydować o bezpieczeństwie zatrudnienia, takich jak przydział pracy, zarządzanie wydajnością, bezpieczeństwo i ochrona, o czym mowa w niniejszym raporcie. Uber i Ola argumentowali w sądzie, że bezpieczeństwo ich platformy może zostać naruszone, jeśli logika takiego przetwarzania danych zostanie ujawniona ich pracownikom. Naszym zdaniem, bezpieczeństwo można poprawić tylko wtedy, gdy platformy w przejrzysty sposób ustalają zasady i standardy wydajności, zamiast polegać na tajnym nadzorze i doraźnych zwolnieniach, które są jednymi z kluczowych motywatorów DSAR.

Biorąc pod uwagę to niechętne nastawienie do DSAR, należy również zauważyć, że wielu kierowców obawia się odwetu ze strony firm za składanie wniosków. Gdy platformy koncertowe przeprowadzają nieumiarkowaną i przedłużającą się kontrolę tożsamości w odpowiedzi na prośby o dostęp do tematu, pracownicy łatwo ulegają zniechęceniu i zastraszeniu (patrz e-maile wysyłane do kierowców przez Ubera w analizach przypadków dotyczących odpowiedzi platformy). W licznych wywiadach, które przeprowadziliśmy z kierowcami, długie wiadomości z prośbą o potwierdzenie, przekazywane w złożonym języku prawniczym, były często określane jako środek odstraszający do realizacji wniosków. Dla wielu kierowców wytrwanie przy żądaniu jest równoznaczne z wystawieniem głowy nad balustradę i narażeniem własnego życia i bezpieczeństwa pracy.

Postrzeganie to często wynika z doświadczeń ciągłego wyzysku i braku bezpieczeństwa, wynikających z ograniczonych zdolności i wiedzy pracowników w zakresie korzystania z praw demokratycznych, czy to w Wielkiej Brytanii jako imigranci, czy w ich ojczystych krajach, które w wielu przypadkach wykazują skłonności autorytarne. W sile roboczej, która jest już bardzo rozdrobniona i podatna na niepewność ekonomiczną, gdzie potrzeba bezpieczeństwa znacznie przewyższa chęć stawienia czoła niesprawiedliwości, nie można przecenić wpływu tego rodzaju wrogiego zachowania ze strony firm. Ta niepewność jest dodatkowo potęgowana przez nieprzejrzystość algorytmów zarządzania. Wobec braku jasnych wyjaśnień, w jaki sposób działają czarnoskrzynkowe systemy alokacji pracy lub zarządzania wydajnością, pracownikom bardzo łatwo jest zaangażować się w spekulacyjne, a nawet konspiracyjne myślenie o tym, jak ich interakcje z platformą wpływają na ich pracę. Może to następnie przerodzić się w uogólnioną nieufność do innych instytucji i niechęć do działalności organizacyjnej. Są to silne i trwałe słabości pracowników, które wymagają szczególnej uwagi i ochrony.

Studia przypadków: Indywidualne DSAR

Poniższe studia przypadków pokazują niektóre sposoby, w jakie Uber angażuje się w obstrukcyjne i niezgodne z przepisami zachowania w odpowiedzi na żądania danych ze strony pracowników. Co istotne, te przykłady nie mogą być wyjaśnione jako wyjątki lub pojedyncze zdarzenia dotyczące niedoświadczonych agentów wsparcia. Odpowiedzi te reprezentują standardowe procedury stosowane przez Uber, gdy pracownicy chcą skorzystać ze swoich praw dostępu do danych.

Okrągłe i daremne odpowiedzi

M. Ahmed jest byłym kierowcą Ubera i kurierem Uber Eats. W październiku 2020 r. zarówno jego konta kierowcy, jak i kuriera Ubera zostały zawieszone, a w lutym 2021 r. jego konto kierowcy zostało dezaktywowane. Wpłynęło to również na jego konto kurierskie UberEats, które zostało następnie dezaktywowane i usunięte.

Kiedy pan Ahmed zapytał o przyczynę swojego zwolnienia, otrzymał sprzeczne odpowiedzi. Uber początkowo powoływał się na nieudaną kontrolę rozpoznawania twarzy, a później twierdził, że dezaktywacja była spowodowana dużą liczbą niedostarczonych zamówień. W całej korespondencji zwracali się do niego pod niewłaściwym nazwiskiem i ostatecznie zaakceptowali, że wiadomości dotyczące nieudanych kontroli tożsamości w czasie rzeczywistym zostały wysłane przez pomyłkę. Zamieszanie wokół jego zwolnienia skłoniło go do poszukiwania swoich danych osobowych.

W ciągu ostatnich kilku miesięcy pan Ahmed próbował odzyskać dane związane z jego dezaktywowanym kontem Uber Eats. Pan Ahmed po raz pierwszy próbował uzyskać swoje dane 15 kwietnia 2021 r., korzystając z formularza „Prześlij zapytanie o prywatność bez konta Uber” na stronie internetowej Uber, ponieważ jego konto zostało usunięte po jego zwolnieniu.

W odpowiedzi otrzymał wiadomość e-mail od Ubera z informacją: „Nasza informacja o ochronie prywatności ogranicza naszą możliwość udostępniania informacji o posiadaczu konta. Możemy przekazać te informacje wyłącznie w ramach procesu opisanego w naszych wytycznych dotyczących żądania danych”. Ten proces odnosi się do zalogowania się na konto i wysłania żądania z poziomu konta. „To powiedziawszy, jesteśmy w stanie współpracować z Tobą za pośrednictwem odpowiednich kanałów, aby pomóc w razie potrzeby”.

Pan Ahmed odpisał, prosząc o radę, w jaki sposób może uzyskać dostęp do danych związanych z jego usuniętym kontem. Wyjaśnił, że pisał z e-maila powiązanego z jego kontem Uber Eats i podał również numer telefonu komórkowego powiązany z tym kontem. Dodał, że chętnie udzieli dalszych informacji potwierdzających jego tożsamość.

W związku z tym pan Ahmed otrzymał odpowiedź stwierdzającą, że jego „troska nie jest związana z tym rachunkiem. Prosimy napisać do nas z konta, którego dotyczy problem, lub zalogować się za pośrednictwem strony help.uber.com, podając odpowiednie dane uwierzytelniające i poinformować nas o problemie, abyśmy mogli udzielić dalszej pomocy”.

Pan Ahmed odpisał, dołączając obraz e-maila wprowadzającego wysłanego do niego przez Ubera w dniu 3 lipca 2020 r., aby wykazać, że pisał z odpowiedniego konta. W dniu 19 kwietnia 2021 r. otrzymał tę samą wiadomość, w której stwierdził, że jego „troska nie ma związku z tą relacją”.

Pan Ahmed odpisał, ponownie wyjaśniając, że nie może uzyskać dostępu do swojego konta i że podał szczegóły związane z jego kontem Uber Eats. Poprosił o wskazówki, jakie inne informacje mógłby podać, aby się zidentyfikować. Nie otrzymał odpowiedzi.

W tym momencie pan Ahmed zwrócił się o pomoc do App Drivers and Couriers Union oraz Worker Info Exchange, a my eskalowaliśmy problem z Uberem. W dniu 11 maja 2021 r. Pan Ahmed otrzymał wiadomość e-mail od Ubera z prośbą o potwierdzenie wniosku złożonego w jego imieniu przez nas. Odpisał, potwierdzając, że udzielił nam swojego mandatu i chciałby, aby jego wniosek został rozpatrzony.

W dniu 14 maja 2021 r. Pan Ahmed otrzymał od Uber formularz weryfikacji tożsamości w celu rozpatrzenia wniosku. W formularzu poproszono o podanie tych samych danych, które udostępnił już w poprzednich wiadomościach, takich jak adres e-mail, numer telefonu, kraj zamieszkania, rodzaj żądanych danych. Poprosił również o jego „obecną ocenę” – co nie miało zastosowania, ponieważ nie miał już dostępu do swojego konta. Pan Ahmed wysłał formularz do Ubera, ale nie otrzymał żadnej odpowiedzi.

W dniu 20 maja 2021 r. pan Ahmed napisał do Ubera, aby uzyskać potwierdzenie, że przetwarzają jego wniosek. Nie otrzymał odpowiedzi.

W chwili pisania tego tekstu pan Ahmed nie otrzymał swoich danych. Nie udzielono mu też żadnego wyjaśnienia, dlaczego jego wniosek nie jest rozpatrywany.

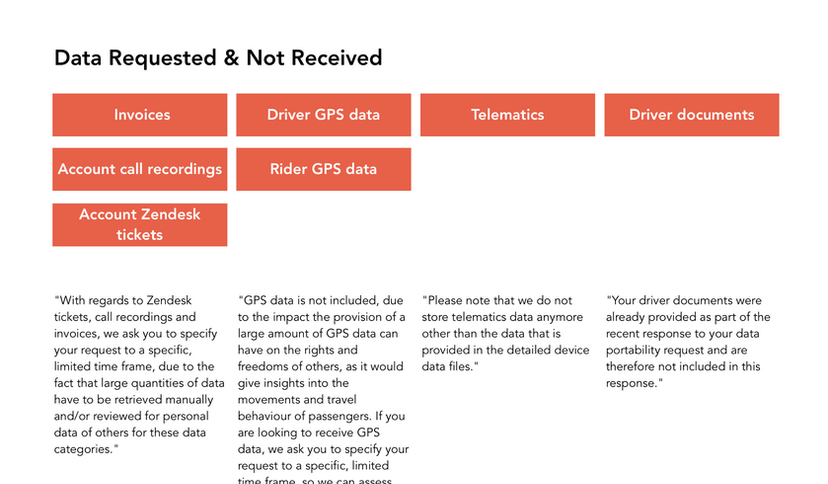

Niespójne i przyrostowe udostępnianie danych

Pan Amini jest byłym kierowcą Ubera, który został dezaktywowany w listopadzie 2020 r. po nieudanym sprawdzeniu geolokalizacji . Uber poinformował o jego zwolnieniu TfL, który następnie cofnął Panu Amini licencję na wynajem prywatny, pozostawiając go bez pracy. Chcąc zrozumieć przyczynę zwolnienia, pan Amini starał się uzyskać swoje dane od Ubera.

Pan Amini złożył pierwszą prośbę w dniu 13 kwietnia 2021 r. i poprosił o wszystkie swoje dane osobowe, w tym 26 kategorii danych określonych w wytycznych opracowanych przez Uber, a także obrazy przesłane przez niego w odpowiedzi na kontrole tożsamości w czasie rzeczywistym. Zaznaczył, że chce danych obejmujących cały okres, w którym był aktywny jako kierowca Ubera.

Pan Amini otrzymał odpowiedź na swoją prośbę w dniu 5 maja 2021 r., jednak podane dane dotyczyły jedynie 30 dni poprzedzających jego wniosek. Ponieważ pan Amini nie mógł pracować dla Ubera w tym okresie, wiele dostarczonych zbiorów danych było pustych.

Następnie Amini złożył kolejną prośbę w dniu 6 maja 2021 r., po raz kolejny stwierdzając, że żąda danych dotyczących całego okresu, w którym pracował z Uberem, dodając konkretnie, że życzył sobie zebrania danych do listopada 2020 r.

Pan Amini otrzymał odpowiedź w dniu 28 maja 2021 r. Jednak po raz kolejny przesłano mu niekompletne dane. W szczególności plik csv szczegółowych danych sterownika dostarczony przez firmę Uber był całkowicie pusty.

Pan Amini złożył kolejną prośbę w dniu 2 czerwca 2021 r., prosząc o brakujące dane. Otrzymał szczegółowe dane dotyczące urządzenia kierowcy za listopad 2020 r. w dniu 10 czerwca 2021 r. Jednak pomimo określenia, że chce mieć wszystkie pola danych wymienione w wytycznych opracowanych przez Ubera, wysłano mu ograniczony zestaw danych, w którym pominięto 32 z 50 danych pola.

Zaciemnianie i opór

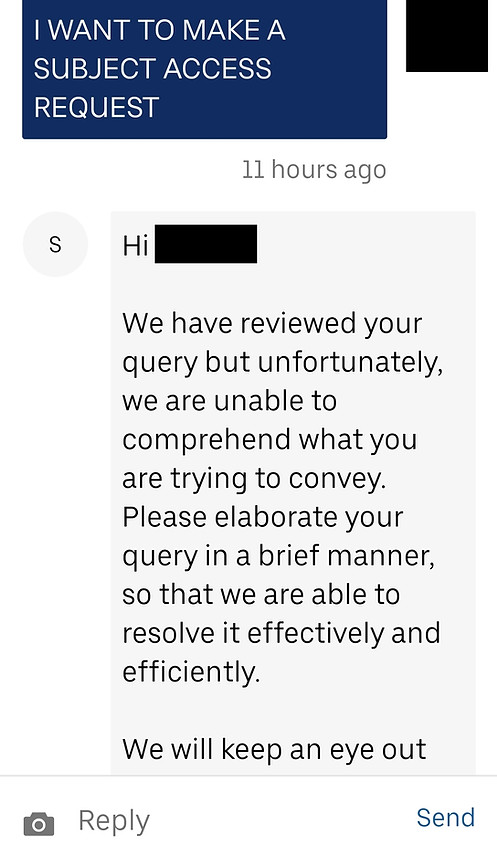

Pan Majid jest byłym kierowcą Ubera, który został dezaktywowany we wrześniu 2020 r. po nieudanym sprawdzeniu geolokalizacji. Podobnie jak w przypadku pana Amini, Uber poinformował TfL o zwolnieniu pana Majida, co spowodowało cofnięcie jego licencji na wynajem prywatny. Starając się zrozumieć podstawy zarzutów Ubera, próbował zdobyć swoje dane.

Pan Majid po raz pierwszy skontaktował się z Uberem, aby poprosić o jego dane w dniu 2 czerwca 2021 r. W odpowiedzi otrzymał wiadomość z prośbą o krótkie rozwinięcie jego wątpliwości. Pan Majid odpowiedział, prosząc o 3 kategorie danych (z 26 kategorii wymienionych w wytycznych Ubera) na wrzesień 2020 r.

W dniu 8 czerwca 2021 r. Pan Majid otrzymał wiadomość od Ubera o treści: „Nasza Polityka prywatności nie pozwala nam na wprowadzanie zmian ani omawianie danych osobowych bez kontaktu za pośrednictwem adresu e-mail powiązanego z Twoim kontem partnerskim. Aby pomóc Ci w rozwiązaniu konkretnego problemu, musisz napisać, korzystając z adresu e-mail powiązanego z tym kontem. Dzięki za zrozumienie."

Na tym etapie Pan Majid skontaktował się z nami, zdezorientowany, pisząc do Ubera ze swojego konta. Odpisał, wyjaśniając Uberowi, że skontaktował się z nimi, logując się na swoje konto kierowcy, więc na pewno pisał z prawidłowego adresu e-mail. Zapytał, czy mógłby dostarczyć dodatkowe dowody tożsamości/dokumenty, aby zapewnić Uberowi, że to on złożył wniosek.

W odpowiedzi otrzymał tę samą wiadomość od Ubera: „Cześć… dziękuję za wiadomość. Rozumiemy, że chcesz omówić informacje związane z kontem Uber. Jeśli jesteś posiadaczem konta, napisz z adresu e-mail powiązanego z Twoim kontem Partner-Driver, a my od razu Ci pomożemy”.

9 czerwca 2021 r. pan Majid zalogował się na swoje konto partnerskie i rozpoczął czat z obsługą Ubera, aby spróbować ponownie. Jego wiadomość z pytaniem, czy mógłby zażądać dostępu do tematu, została zignorowana.

W dniu 14 czerwca 2021 r. Pan Majid ponownie skontaktował się z Uberem, informując, że ma pytanie dotyczące konta partnera kierowcy. Otrzymał odpowiedź od Ubera: „Dziękujemy za skontaktowanie się z nami… Skorzystaliśmy z okazji, aby sprawdzić Twoje obawy i widzimy, że już wcześniej skontaktowałeś się z nami w tej sprawie. Jeden z członków naszego zespołu obecnie bada Twój problem i skontaktujemy się z Tobą tak szybko, jak to możliwe. Aby usprawnić naszą komunikację i uniknąć nieporozumień, zamierzamy zamknąć ten kontakt”.

W dniu 16 czerwca 2021 r. Pan Majid ponownie skontaktował się z Uberem, stwierdzając, że został poproszony o zalogowanie się na swoje konto w celu złożenia wniosku, a po zrobieniu tego chciał udostępnić szczegóły swojej prośby. Otrzymał odpowiedź następnego dnia, a następnie przesłał szczegóły żądania (z trzech wymienionych powyżej zbiorów danych) w dniu 18 czerwca 2021 r.

Nie otrzymawszy odpowiedzi, Pan Majid ponownie skontaktował się z Uberem w dniu 28 czerwca 2021 r., prosząc o potwierdzenie, że jego wniosek jest rozpatrywany. W dniu 1 lipca 2021 r. otrzymał odpowiedź, w której stwierdzono, że jego obawy zostały zgłoszone wyspecjalizowanemu zespołowi i że będą w kontakcie w celu dalszego dochodzenia.

W dniu 2 lipca 2021 r. Pan Majid otrzymał odpowiedź na wątek wiadomości, który zainicjował w dniu 9 czerwca 2021 r. W tej wiadomości stwierdzono, że Uber wymaga, aby wnioski były osobiście doręczane na adres pocztowy Uber BV w Holandii.

Pan Majid nie otrzymał żadnej dalszej korespondencji.

„Kwestia algorytmów ma kluczowe znaczenie dla tematu uberyzacji. Zbyt często to algorytm odgrywa prawdziwą rolę szefa, ponieważ technologia zapewnia nowe sposoby podporządkowania pracowników. Oczywiście istnieje potrzeba przejrzystości zarządzania algorytmicznego, ale poza tą przejrzystością istnieje potrzeba współzarządzania algorytmem. Przedstawiciele pracowników muszą mieć możliwość uczestniczenia w ich rozwoju”.

Leïla Chaibi, posłanka do PE

Studia przypadków: Odpowiedzi platformy na

Żądania wsadowe przez wymianę informacji o pracownikach

Jak pokazują powyższe przykłady, poszczególne procesy żądań mogą być niezwykle czasochłonne i wymagające dużej pojemności. Dlatego stworzyliśmy procesy, które umożliwiają nam składanie żądań wsadowych w imieniu kierowców i usprawnienie tej złożonej procedury. Stworzyliśmy system wykorzystujący rozwiązanie do podpisu elektronicznego i identyfikatora opracowane przez Scrive, aby otrzymać od pracowników upoważnienie prawne do składania wniosków w ich imieniu. To rozwiązanie obejmuje również weryfikację tożsamości prowadzoną przez Onfido (ta sama usługa weryfikacji tożsamości, z której korzysta Uber), aby zapewnić, że zarówno my, jak i administrator danych możemy być pewni tożsamości osoby zgłaszającej żądanie i zachować prywatność jego danych. Weryfikacja tożsamości wymaga od pracownika przedstawienia jednego z następujących dokumentów tożsamości: paszport, prawo jazdy, dowód osobisty lub zezwolenie na pobyt. W ramach tego procesu dla każdej osoby tworzony jest indywidualny dokument zgody, który jest zapieczętowany elektronicznie i można go zweryfikować za pomocą ukrytych załączników zawierających rejestr dowodów w celu udowodnienia autentyczności procesu identyfikacji. (Scrive świadczy również usługę weryfikacji integralności formularzy zgody, do których prowadzą linki w dokumentach). Wysyłamy te dokumenty wraz z arkuszem kalkulacyjnym zawierającym nazwiska, adresy e-mail, adresy i numery telefonów pracowników składających wnioski.

Niektóre firmy były uprzejme i chętne do współpracy w odpowiedzi na prośby zgłoszone w ramach tej procedury, podczas gdy inne zaangażowały się w znacznie bardziej obstrukcyjne i wrogie zachowanie. Jednak nawet jeśli firmy zastosowały się do żądań, występowały spójne problemy z ustaleniem dokładnych kategorii gromadzonych danych, a także z uzyskaniem wszystkich żądanych danych w ustrukturyzowanym i nadającym się do odczytu maszynowego formacie. Niewiele firm było w stanie dostarczyć wytyczne z jasnymi opisami kategorii danych, a otrzymane przez nas dane często wykazywały znaczne niezgodności z przetwarzaniem opisanym w politykach prywatności. Ogólnie rzecz biorąc, firmy wykazują tendencję do zaprzeczania praktykom dotyczącym danych, których nie chcą ujawniać. W jednym przypadku firma twierdziła, że ocena oszustw, o której mowa w ich polityce prywatności, została przeprowadzona tylko w ramach procesu i że polityka prywatności jest nieaktualna. Inny odesłał nas do dokumentu, który, jak twierdzili, zastąpił ten, na którym opieraliśmy naszą prośbę, mimo że oba dokumenty zostały zaktualizowane w tym samym dniu.

Pomimo tych trudności, najbardziej kontrowersyjną reakcją, z jaką się spotkaliśmy, była odmowa naszego prawa do działania w imieniu pracowników podczas składania wniosków o dostęp do podmiotu jako strona trzecia. To jednoznaczne prawo (wyraźnie określone w wytycznych ICO, a nawet promowane przez rządową propozycję reformy RODO ) zostało zakwestionowane zarówno przez Bolta, jak i Ubera. Chociaż oczywiste jest, że opór ma na celu udaremnienie procesu składania wniosku, wskazuje on również na istotną lukę w istniejących wytycznych dotyczących procesów weryfikacji tożsamości. Kiedy firmy nalegają na przeprowadzanie kontroli tożsamości poprzez bezpośredni kontakt z pracownikami, poddając ich skomplikowanej prawnie korespondencji, w dużej mierze neguje to cel zwracania się do stron trzecich o wnioski. Istnieje niepokojący konflikt między prawami odpowiednich stron, który wymaga pilnych wskazówek regulacyjnych, aby zapewnić, że nie są nadużywane i manipulowane w celu pogłębienia asymetrii informacyjnych.

Dostawa

Spośród siedmiu firm, do których zwróciliśmy się z prośbą, Deliveroo był najbardziej zgodny. W naszych prośbach poprosiliśmy firmy o potwierdzenie terminu, w którym zostanie udzielona odpowiedź na wniosek oraz o zbiorcze przetwarzanie wniosków, informując nas o każdym indywidualnym ujawnieniu.

Deliveroo odpowiedział na żądania w terminie określonym prawem, pod warunkiem, że: dokument z wytycznymi, wyraźnie opisujący kategorie danych i przekazywany nam w trakcie tego procesu.

Darmowe Teraz

Free Now spełniło naszą prośbę w oczekiwanym terminie i zareagowało w trakcie całego procesu, jednak napotkaliśmy kilka problemów, które warto podkreślić.

1) Free Now początkowo próbował skierować nas do swojego formularza kontaktowego online, aby złożyć wniosek. To nie odpowiadało rozmiarowi dokumentów, które musieliśmy udostępnić. Udało nam się uzyskać wiadomość e-mail od inspektora ochrony danych dopiero po wielokrotnych e-mailach wyjaśniających problem.

2) Otrzymane przez nas dane nie obejmowały niektórych kategorii danych, o które prosiliśmy, takich jak dane dotyczące algorytmu „losowego lasu” stosowanego do zapobiegania oszustwom. Wyjaśniono to w Polityka prywatności kierowców , która stwierdza: „Na podstawie obliczonego wyniku jesteśmy w stanie odpowiednio ustalić priorytety wysłanych podróży. Zapewnia to uczciwą i minimalizującą ryzyko wysyłkę.” Kiedy zwracaliśmy na to uwagę, Free Now stwierdził:

„Nie przetwarzamy ocen oszustw dotyczących naszych kierowców i nie używamy (i nie używaliśmy) algorytmu wykrywania oszustw w odniesieniu do naszych kierowców i/lub ich danych osobowych.

Sekcja 3.4 naszego oświadczenia o ochronie prywatności kierowcy wymaga zatem aktualizacji w tym zakresie i przepraszamy za wszelkie nieporozumienia w tym zakresie. Tytułem tła po raz pierwszy wprowadziliśmy tę sekcję do zawiadomienia w związku z testami przeprowadzanymi przez nasz Dział Revenue Assurance. Jednak żadne sterowniki nigdy nie zostały uwzględnione w tych testach, a zatem nie stworzono żadnych wyników oszustw związanych ze sterownikami (lub podobnych). Od tego czasu przestaliśmy przeprowadzać te testy”.

3) W odpowiedzi na naszą prośbę o towarzyszące wytyczne zawierające opisy kategorii danych, poinformowano nas:

„Biorąc pod uwagę dostępny, zwięzły i zrozumiały format przedmiotowych danych, nie są wymagane żadne dodatkowe wytyczne w odniesieniu do tych wniosków”.

„Nie przetwarzamy ocen oszustw dotyczących naszych kierowców i nie używamy (i nie używaliśmy) algorytmu wykrywania oszustw w odniesieniu do naszych kierowców i/lub ich danych osobowych.

Sekcja 3.4 naszego oświadczenia o ochronie prywatności kierowcy wymaga zatem aktualizacji w tym zakresie i przepraszamy za wszelkie nieporozumienia w tym zakresie. Tytułem tła po raz pierwszy wprowadziliśmy tę sekcję do zawiadomienia w związku z testami przeprowadzanymi przez nasz Dział Revenue Assurance. Jednak żadne sterowniki nigdy nie zostały uwzględnione w tych testach, a zatem nie stworzono żadnych wyników oszustw związanych ze sterownikami (lub podobnych). Od tego czasu przestaliśmy przeprowadzać te testy”.

„Biorąc pod uwagę dostępny, zwięzły i zrozumiały format przedmiotowych danych, nie są wymagane żadne dodatkowe wytyczne w odniesieniu do tych wniosków”.

„Aby zapobiec nieuczciwej działalności, przechowujemy Twoje dane lokalizacyjne GPS przesłane do nas przez Twoje urządzenie mobilne w krótkich odstępach czasu od momentu przyjęcia do zakończenia wycieczki. Dzięki temu FREE NOW może stworzyć mapę całego przebiegu wycieczki. W ten sposób chcemy zapewnić, aby kierowcy nie przedłużali celowo trasy w celu uzyskania wyższej opłaty. Jednocześnie możemy skorygować nieuzasadnione reklamacje pasażerów dzięki możliwości śledzenia faktycznego przebiegu i trasy do wycieczki. Przetwarzanie Twoich danych lokalizacyjnych GPS podczas wycieczki odbywa się dla Twojej własnej ochrony, jak również dla ochrony pasażera i dla naszej ochrony na podstawie art. 6 ust. 1 lit. f RODO.”

Amazon Flex

Amazon Flex początkowo odpowiedział na żądania, prosząc o identyfikację osób, których dane dotyczą, jednak po otrzymaniu wyjaśnienia weryfikacji przeprowadzonej za pośrednictwem Onfido zgodzili się, że zostały dostarczone wystarczające informacje o osobach, których dane dotyczą, aby spełnić żądania.

Po potwierdzeniu Amazon Flex poinformował nas, że będzie potrzebował dwóch dodatkowych miesięcy, aby w pełni odpowiedzieć na prośby.