Cuprins

Cuprins

rezumat

Partea I: Clasificare greșită 2.0: Controlat de algoritm

Studiu de caz de supraveghere I: Eșecul recunoașterii faciale

Studiu de caz de supraveghere II: Verificări de geolocalizare

Managementul performanței opace

Studiu de caz: Control algoritmic

Extinderea infrastructurii de aplicare a legii

Studiu de caz: Partajarea informațiilor cu forțele de ordine

Partea a II-a: Exercitarea drepturilor asupra datelor la locul de muncă: Acces

Studii de caz: DSAR-uri individuale

Răspunsuri circulare și zadarnice

Partajarea inconsecventă și incrementală a datelor

Studii de caz: Răspunsurile platformei la solicitările de loturi din partea WIE

Partea a III-a: Exercitarea drepturilor asupra datelor la locul de muncă: Litigii

Șoferi Uber v Uber I (cereri generale de transparență)

Ola drivers v. Ola (cereri generale de transparență)

Șoferi Uber v. Uber II (transparență privind luarea automată a deciziilor)

Cazuri de apel pentru acordarea licențelor din Londra

Concluzie: calea de urmat pentru exercitarea drepturilor digitale la locul de muncă?

rezumat

Worker Info Exchange a fost înființat pentru a facilita accesul și colectivizarea datelor pentru a construi puterea de negociere prin stabilirea unui trust de date.

Acest lucru a fost ca răspuns la dezvoltarea de noi practici de management algoritmic care creează asimetrii informaționale profunde și exploatarea lucrătorilor.

Worker Info Exchange își propune să abordeze convergența datelor și a drepturilor de muncă prin invocarea drepturilor articolelor 15, 20 și 22 din GDPR în contexte de angajare.

Acest obiectiv este grav împiedicat de neconformitatea pe scară largă a GDPR în industria gig-urilor.

În ultimele opt luni, am făcut peste 500 de solicitări de acces pentru persoanele vizate către șapte platforme diferite de transport partajat, inclusiv Amazon Flex, Bolt, Deliveroo, Free Now, Just Eat, Ola și Uber.

Accesul la date este contestat de companiile care implementează modele întunecate și abuzează în mod deliberat de implementarea neregulată a GDPR, ceea ce îi determină pe lucrători să rezolve problemele în instanță.

Colectarea datelor de către platformele gig este excesivă și duce la supravegherea disproporționată și neresponsabilă a lucrătorilor, precum și la extinderea infrastructurii de aplicare a legii.

Nu există transparență asupra sistemelor de management algoritmic care sunt utilizate. Narațiunile companiei despre ce tehnologii sunt utilizate și cum sunt inconsistente și nesigure.

© 2021 Schimb de informații despre lucrători

© 2021 Schimb de informații despre lucrători

Introducere

Anul trecut a marcat un punct de cotitură pentru lucrătorii platformei de concerte în realizarea drepturilor lor digitale și de angajare. Practica muncii mediate digital a condus la o convergență a drepturilor de angajare și de protecție a datelor, iar activitatea în creștere a litigiilor și advocacy a lucrătorilor a dat rezultate în aceste domenii. În toată Europa, instanțele au pronunțat mai multe hotărâri importante care recunosc rolul de exploatare al practicilor de management algoritmic de către platformele gig, condamnând, de asemenea, lipsa de corectitudine și transparență în astfel de sisteme automate.

În Italia, instanța de la Bologna a decis că sistemul de rating Deliveroo a discriminat lucrătorii, în timp ce autoritatea de protecție a datelor, Garante, a aplicat două amenzi GDPR Deliveroo și Glovo din cauza eșecului lor de a dezvălui în mod adecvat funcționarea algoritmilor de alocare a locurilor de muncă și de management al performanței.

Spania a adoptat prima legislație pentru a încerca să reglementeze IA în domeniul ocupării forței de muncă, stabilind atât statutul de lucrător pentru lucrătorii din gig, cât și dreptul de a fi informați cu privire la regulile și parametrii algoritmilor la care sunt supuși - declanșând un torent de plângeri. Acest lucru a rezultat dintr-un alt proces împotriva Glovo care a ajuns la Curtea Supremă Spaniolă.

Alături de aceste decizii importante, Curtea Supremă a Regatului Unit a concluzionat, de asemenea, în acest an că șoferii Uber au fost parte la un serviciu de transport care este „ foarte strâns definit și controlat de Uber ”, trădând o relație de muncă clară, despre care compania a susținut că nu a existat în efortul său de a clasifica (greși) lucrătorii ca antreprenori independenți. În mod semnificativ, dovezile acestei relații provin din sistemele bazate pe date pe care platformele de transport partajat le folosesc pentru a-și gestiona forța de muncă. Unele dintre problemele evidențiate de Curtea Supremă din Regatul Unit s-au referit la gestionarea șoferilor prin monitorizarea algoritmică a ratelor de acceptare a locurilor de muncă, a alegerilor de rută, a comportamentului de conducere și a evaluărilor clienților. Cu toate acestea, deși există o mai mare recunoaștere a managementului algoritmic, câștigurile recente din instanțe nu protejează pe deplin lucrătorii împotriva daunelor sale. Partea (b) statutul de lucrător acordat șoferilor Uber ca urmare a deciziei Curții Supreme este un statut de intermediar între antreprenor și angajat și încă nu îi protejează de concedieri abuzive, de exemplu.

Experiența noastră sugerează că aceste instrumente de management algoritmic, la care se adaugă intensificarea practicilor de supraveghere, monitorizarea continuă a lucrătorilor pentru eventuale fraude sau fapte greșite, au ca rezultat un mediu de lucru profund exploatant. Asistăm la un număr exagerat de concedieri automate în întreaga industrie a concertelor, dintre care multe considerăm că sunt ilegale în conformitate cu articolul 22 din Regulamentul general privind protecția datelor (GDPR) . Articolul 22 oferă lucrătorilor anumite protecții limitate împotriva efectelor adverse ale luării automate a deciziilor și ale profilării, prin dreptul de a obține intervenția umană și de a contesta decizia. Articolul 15 din GDPR garantează dreptul de a fi informat cu privire la existența unei astfel de decizii automate și de a primi informații semnificative despre logica prelucrării.

Luând ca bază aceste drepturi, Worker Info Exchange a fost înființat cu misiunea de a sprijini lucrătorii din gig în navigarea în acest complex și în spațiu reglementat. Scopul și misiunea muncii noastre este de a testa dacă aceste instrumente GDPR pot fi utilizate pentru a aborda practicile neloiale de angajare și pentru a extinde domeniul de aplicare al datelor puse la dispoziție persoanelor în calitatea lor de lucrători. Cu alte cuvinte, ambiția noastră este să folosim accesul la date ca metodă de a construi puterea colectivă a lucrătorilor pentru testarea mecanismelor de despăgubire pe o piață a muncii mediată digital.

Atunci când relația de muncă dintre platforma gig și lucrător este executată prin colectarea și analiză extinsă de date, drepturile de angajare devin indisolubil legate de exercitarea drepturilor de date. Platformele Gig afirmă controlul asupra lucrătorilor prin menținerea unei asimetrii informaționale, iar accesul la date poate oferi un mijloc de a expune (dezechilibrul) de putere generat de decalajul informațional dintre platformele de gig și lucrătorii lor. Obținerea accesului la datele cu caracter personal poate permite lucrătorilor să facă evaluări independente cu privire la condițiile lor de muncă și să răspundă la întrebări referitoare la calculele lor salariale, calitatea și cantitatea muncii oferite, precum și contestarea motivelor pentru managementul negativ al performanței, inclusiv suspendarea și concediere.

Scopul nostru în facilitarea accesului la date este de a crea depozite colective de date pentru a dezvolta o mai bună înțelegere a condițiilor de muncă și, în consecință, a puterii de negociere. În ultimii ani, au apărut o serie de inițiative demne de remarcat, care funcționează cu scopuri similare, dar utilizând metodologii diferite pentru preluarea datelor. Unele proiecte din acest domeniu își desfășoară propria colectare de date și analize privind câștigurile și performanța pentru a evalua corectitudinea condițiilor de muncă (de exemplu Driver's Seat Coop și WeClock, printre altele.) Toate acestea prezintă perspective unice asupra economiei gig și ar trebui considerate ca constituind un continuum de practică a datelor. Am abordat această problemă cerând platformelor să partajeze datele la care lucrătorii au dreptul legal, însă acest lucru a introdus obstacole suplimentare în scopul mai larg de colectivizare a datelor. Am luat această cale pentru că ne-am dorit să stabilim standarde și precedente în legea protecției datelor, dar și pentru că credem că există anumite tipuri de informații care pot fi obținute doar prin solicitarea datelor direct de pe platforme.

Am constatat, în special în cazul acuzațiilor alimentate de supraveghere de activitate neregulată și fraudă, că este necesar să avem datele deținute de companii pentru a înțelege și a contesta acuzațiile. Accesul la date ne poate ajuta să descoperim inconsecvențele din narațiunile avansate de companiile de platformă și ne poate ajuta să transferăm sarcina probei de la lucrători pe platforme. Din această perspectivă, efortul de a solicita date platformei s-a dovedit extrem de reușit în soluționarea a numeroase dispute de muncă. Simpla demonstrație a refuzului platformelor de a furniza date cu caracter personal a anulat mai multe revocări de licență (executate de TfL) în instanță și a devenit astfel un instrument suplimentar în exercitarea drepturilor de muncă.

Aceasta constituie cealaltă ramură de activitate a Schimbului de informații lucrător; întrucât suntem frustrați în încercările noastre de a obține claritate și transparență asupra sistemelor complexe care determină condițiile la locul de muncă, trebuie frecvent să apelăm la litigii și să apelăm la instanțe pentru decizii în domeniul emergent al drepturilor de muncă digitale. „Criza de date” artificială pe care platformele de concerte au creat-o este în multe privințe o încercare de a epuiza și de a epuiza resursele lucrătorilor precari și ale sindicatelor deopotrivă, atragând litigiile în instanțe, unde pot fi prelungite și răspunderea pentru comportamentul necorespunzător al corporațiilor amânată.

În conformitate cu aceste direcții de activitate, acest raport este scris în trei părți: Prima secțiune explorează diferite fațete ale managementului algoritmic și daunele acestuia, cu studii de caz asociate. A doua secțiune tratează procesul nostru de utilizare a cererilor de acces pentru subiectul datelor (DSAR), în timp ce a treia oferă o privire de ansamblu asupra cazurilor legate de GDPR pe care le-am înaintat în Amsterdam, precum și a cazurilor de licențiere pe care le sprijinim la Londra. Acest raport încheie o perioadă de lucru care abordează aceste funcții ale organizației noastre, desfășurată cu sprijinul Fundației Mozilla, Digital Freedom Fund și Open Society Foundations. Sperăm că acest raport va demonstra stadiul actual al exercitării drepturilor la intersecția datelor și a muncii și va dezvălui efectele cumulate ale neconformității repetate de către platformele gig.

„Companiile de platforme operează într-un spațiu fără lege în care cred că pot stabili regulile. Din păcate, acesta nu este un joc; realitățile virtuale au consecințe dure pentru lucrătorii din gig în viața reală. Ceea ce este încurajator este că lucrătorii înșiși nu așteaptă legi, factorii de decizie politică sau chiar aliați din mișcarea pentru drepturile omului pentru a-i salva. Lucrătorii de la Gig se organizează și își folosesc vocea colectivă pentru a cere noi protecții adecvate scopului unei economii digitalizate.”

Bama Athreya, Fellow, Open Society Foundations

Partea I: Clasificare greșită 2.0 Controlat de algoritm

În bătălia de șase ani pentru drepturile lucrătorilor în economia gig a Regatului Unit, Uber a susținut că a fost doar agentul șoferului care desfășoară o activitate independentă, care nu face altceva decât să rezerve pasiv comenzile de muncă și să încaseze plăți. Pentru a promova această ficțiune, platformele de concerte au stabilit contracte elaborate care fac să pară că șoferul și pasagerul fac tranzacții direct unul cu celălalt, când, de fapt, toate informațiile despre pasageri sunt protejate îndeaproape de companii. Uber, de exemplu, generează o factură noțională în numele șoferului pentru fiecare pasager pe care îl transportă. Factura va cita doar prenumele pasagerului și nu este niciodată trimisă clientului.

Aceste tehnici de clasificare greșită, utilizate în mod obișnuit în economia gig, permit platformelor să evite responsabilitățile legale ale angajatorului, cum ar fi protecția drepturilor de bază ale lucrătorilor și contribuțiile naționale de asigurări. În Marea Britanie, a permis companiilor de platformă să evite taxa pe valoarea adăugată pe vânzări (TVA). Dar la începutul acestui an, Curtea Supremă a afirmat dreptul instanțelor inferioare de a renunța la contracte artificiale și de a determina adevărata natură a raportului de muncă pe baza dovezilor unei relații de conducere de control asupra lucrătorilor.

Întrucât companiile de platformă concluzionează că utilizarea contractelor înșelătoare nu mai este viabilă ca metodă de clasificare greșită a angajării, vor fi tentate să dubleze automatizarea proceselor pentru ascunderea controlului de management. Controlul algoritmic devine clasificare greșită 2.0. Într-adevăr, există dovezi ample că acest lucru se întâmplă deja. Platformele Gig sunt mai hotărâte ca niciodată să urmărească strategii de clasificare greșită, astfel încât să poată continua să controleze forța de muncă, evitând în același timp riscul ca șoferii să treacă de la statutul de „lucrător” cu drepturi limitate la statutul de angajat cu mult mai multe drepturi.

Deci, ce este controlul algoritmic și care sunt riscurile specifice pentru lucrătorii din gig? În special în industriile de transport partajat și de livrare, mijloacele de management algoritmic care ne preocupă cel mai mult includ următoarele:

Supraveghere. Supraveghere intruzivă în scopul declarat de securitate și identificare. Aceasta include utilizarea tehnologiilor de detectare a fraudelor și de recunoaștere facială. Suntem conștienți că supravegherea este efectuată chiar și atunci când lucrătorul nu s-a autentificat pentru a se pune la dispoziție pentru muncă. De asemenea, a inclus și supravegherea utilizării aplicației de către lucrător ca consumator.

Managementul performantei. Aceasta include, dar nu se limitează la, monitorizarea comportamentului de conducere, inclusiv ETA, evaluările clienților, ratele de acceptare și finalizare a locurilor de muncă, interacțiunea cu personalul de asistență, disponibilitate.

Alocarea muncii. Până de curând, Uber a insistat că alocarea muncii este decisă în funcție de apropierea șoferilor și pasagerilor unul față de celălalt, totuși acum admit că comportamentul și preferințele din trecut sunt luate în considerare. Ola admite că profilurile șoferilor care includ scorul „profilul de câștig” și „probabilitatea de fraudă” sunt utilizate în luarea deciziilor automatizate de alocare a muncii.

Prețuri. Strâns legată de alocarea muncii este luarea automată a deciziilor privind prețurile. Poate că cea mai cunoscută metodă este așa-numita „supraveghere” sau „preț dinamic” de la Uber, care urmărește să clarifice cererea pieței cu fluctuații de preț locale în timp real.

Deciziile de management de mai sus sunt în mare parte automatizate sau semi-automatizate cu intervenție umană limitată. Modelele de afaceri ale economiei gig se bazează pe automatizarea în masă a deciziilor de management și pe supravegherea locului de muncă. În timp ce unii angajatori sunt reticenți în privința acestui punct, Deliveroo a fost destul de direct în politica lor de confidențialitate a utilizatorului :

„Având în vedere volumul de livrări cu care ne confruntăm, folosim sisteme automatizate pentru a lua deciziile automatizate descrise mai sus, deoarece acestea oferă o modalitate mai precisă, echitabilă și eficientă de a identifica frauda suspectată, prevenind încălcările repetate ale Acordului cu furnizorul și limitând impactul negativ asupra serviciul nostru. Controalele umane pur și simplu nu ar fi posibile în intervalele de timp și având în vedere volumele de livrări cu care ne ocupăm.”

Managementul performantei

Aceasta include, dar nu se limitează la, monitorizarea comportamentului de conducere, inclusiv ETA, evaluările clienților, ratele de acceptare și finalizare a locurilor de muncă, interacțiunea cu personalul de asistență, disponibilitate.

Prețuri

Strâns legată de alocarea muncii este luarea automată a deciziilor privind prețurile. Poate că cea mai cunoscută metodă este așa-numita „supraveghere” sau „prețuri dinamice” de la Uber, care urmărește să clarifice cererea pieței cu fluctuații ale prețurilor locale în timp real.

Supraveghere

Supraveghere intruzivă în scopul declarat de securitate și identificare. Aceasta include utilizarea tehnologiilor de detectare a fraudelor și de recunoaștere facială. Suntem conștienți că supravegherea este efectuată chiar și atunci când lucrătorul nu s-a autentificat pentru a se pune la dispoziție pentru muncă. De asemenea, a inclus și supravegherea utilizării aplicației de către lucrător ca consumator.

Alocarea muncii

Până de curând, Uber a insistat că alocarea muncii este decisă în funcție de apropierea șoferilor și pasagerilor unul față de celălalt, totuși acum admit că comportamentul și preferințele din trecut sunt luate în considerare. Ola admite că profilurile șoferilor care includ scorul „profilul de câștig” și „probabilitatea de fraudă” sunt utilizate în luarea deciziilor automatizate de alocare a muncii.

Partea I: Clasificare greșită 2.0 Controlat de algoritm

În bătălia de șase ani pentru drepturile lucrătorilor în economia gig a Regatului Unit, Uber a susținut că a fost doar agentul șoferului care desfășoară o activitate independentă, care nu face altceva decât să rezerve pasiv comenzile de muncă și să încaseze plăți. Pentru a promova această ficțiune, platformele de concerte au stabilit contracte elaborate care fac să pară că șoferul și pasagerul fac tranzacții direct unul cu celălalt, când, de fapt, toate informațiile despre pasageri sunt protejate îndeaproape de companii. Uber, de exemplu, generează o factură noțională în numele șoferului pentru fiecare pasager pe care îl transportă. Factura va cita doar prenumele pasagerului și nu este niciodată trimisă clientului.

Aceste tehnici de clasificare greșită, utilizate în mod obișnuit în economia gig, permit platformelor să evite responsabilitățile legale ale angajatorului, cum ar fi protecția drepturilor de bază ale lucrătorilor și contribuțiile naționale de asigurări. În Marea Britanie, a permis companiilor de platformă să evite taxa pe valoarea adăugată pe vânzări (TVA). Dar la începutul acestui an, Curtea Supremă a afirmat dreptul instanțelor inferioare de a renunța la contracte artificiale și de a determina adevărata natură a raportului de muncă pe baza dovezilor unei relații de conducere de control asupra lucrătorilor.

Întrucât companiile de platformă concluzionează că utilizarea contractelor înșelătoare nu mai este viabilă ca metodă de clasificare greșită a angajării, vor fi tentate să dubleze automatizarea proceselor pentru ascunderea controlului de management. Controlul algoritmic devine clasificare greșită 2.0. Într-adevăr, există dovezi ample că acest lucru se întâmplă deja. Platformele Gig sunt mai hotărâte ca niciodată să urmărească strategii de clasificare greșită, astfel încât să poată continua să controleze forța de muncă, evitând în același timp riscul ca șoferii să treacă de la statutul de „lucrător” cu drepturi limitate la statutul de angajat cu mult mai multe drepturi.

Deci, ce este controlul algoritmic și care sunt riscurile specifice pentru lucrătorii din gig? În special în industriile de transport partajat și de livrare, mijloacele de management algoritmic care ne preocupă cel mai mult includ următoarele:

Supraveghere. Supraveghere intruzivă în scopul declarat de securitate și identificare. Aceasta include utilizarea tehnologiilor de detectare a fraudelor și de recunoaștere facială. Suntem conștienți că supravegherea este efectuată chiar și atunci când lucrătorul nu s-a autentificat pentru a se pune la dispoziție pentru muncă. De asemenea, a inclus și supravegherea utilizării aplicației de către lucrător ca consumator.

Managementul performantei. Aceasta include, dar nu se limitează la, monitorizarea comportamentului de conducere, inclusiv ETA, evaluările clienților, ratele de acceptare și finalizare a locurilor de muncă, interacțiunea cu personalul de asistență, disponibilitate.

Alocarea muncii. Până de curând, Uber a insistat că alocarea muncii este decisă în funcție de apropierea șoferilor și pasagerilor unul față de celălalt, totuși acum admit că comportamentul și preferințele din trecut sunt luate în considerare. Ola admite că profilurile șoferilor care includ scorul „profilul de câștig” și „probabilitatea de fraudă” sunt utilizate în luarea deciziilor automatizate de alocare a muncii.

Prețuri. Strâns legată de alocarea muncii este luarea automată a deciziilor privind prețurile. Poate că cea mai cunoscută metodă este așa-numita „supraveghere” sau „preț dinamic” de la Uber, care urmărește să clarifice cererea pieței cu fluctuații de preț locale în timp real.

Deciziile de management de mai sus sunt în mare parte automatizate sau semi-automatizate cu intervenție umană limitată. Modelele de afaceri ale economiei gig se bazează pe automatizarea în masă a deciziilor de management și pe supravegherea locului de muncă. În timp ce unii angajatori sunt reticenți în privința acestui punct, Deliveroo a fost destul de direct în politica lor de confidențialitate a utilizatorului :

„Având în vedere volumul de livrări cu care ne confruntăm, folosim sisteme automatizate pentru a lua deciziile automatizate descrise mai sus, deoarece acestea oferă o modalitate mai precisă, echitabilă și eficientă de a identifica frauda suspectată, prevenind încălcările repetate ale Acordului cu furnizorul și limitând impactul negativ asupra serviciul nostru. Controalele umane pur și simplu nu ar fi posibile în intervalele de timp și având în vedere volumele de livrări cu care ne ocupăm.”

„Având în vedere volumul de livrări cu care ne confruntăm, folosim sisteme automatizate pentru a lua deciziile automatizate descrise mai sus, deoarece acestea oferă o modalitate mai precisă, echitabilă și eficientă de a identifica frauda suspectată, prevenind încălcările repetate ale Acordului cu furnizorul și limitând impactul negativ asupra serviciul nostru. Controalele umane pur și simplu nu ar fi posibile în intervalele de timp și având în vedere volumele de livrări cu care ne ocupăm.”

Supraveghere

Supraveghere intruzivă în scopul declarat de securitate și identificare. Aceasta include utilizarea tehnologiilor de detectare a fraudelor și de recunoaștere facială. Suntem conștienți că supravegherea este efectuată chiar și atunci când lucrătorul nu s-a autentificat pentru a se pune la dispoziție pentru muncă. Include, de asemenea, supravegherea utilizării aplicației de către lucrător în calitate de consumator.

Alocarea muncii

Până de curând, Uber a insistat că alocarea muncii este decisă în funcție de apropierea șoferilor și a pasagerilor unul față de celălalt, dar acum afirmă că comportamentul și preferințele din trecut sunt luate în considerare. Ola folosește profiluri de șoferi care includ „scoruri de probabilitate a fraudei” în luarea automată a deciziilor pentru muncă. alocare.

Managementul performantei

Evaluarea performanței muncii include, dar nu se limitează la, monitorizarea comportamentului de conducere, inclusiv ETA, evaluările clienților, ratele de acceptare și finalizare a postului, interacțiunea cu personalul de asistență, disponibilitate.

Prețuri

Strâns legată de alocarea muncii este stabilirea automată a prețurilor. Poate că cea mai cunoscută metodă este așa-numita „supraveghere” sau „preț dinamic” de la Uber, care urmărește să clarifice cererea pieței cu fluctuații de preț locale în timp real.

Cursa înarmărilor de supraveghere

Asistăm la o cursă a înarmărilor de supraveghere în economia gig de când Uber a introdus așa-numitul sistem hibrid de identificare în timp real în 2020. Cu doar o zi înainte ca Transport for London (TfL) să-și anunțe decizia de a refuza reînnoirea licenței în noiembrie 2019, Uber s-a oferit să introducă acest sistem de supraveghere care încorporează recunoașterea facială cu monitorizare GPS.

Acesta a fost răspuns la plângerea TfL conform căreia 21 de șoferi au fost detectați (din 90.000 analizați de-a lungul mai multor ani) ca fiind implicați în partajarea contului, ceea ce a permis șoferilor potențial fără licență și neasigurați să-și ofere ilegal serviciile pe aplicație. Activitatea a fost posibilă prin resetarea locației GPS a dispozitivului ca în afara Marii Britanii, unde este posibil ca șoferii să își încarce propriile fotografii. Acest decalaj a fost rapid eliminat de Uber, iar activitatea detectată a fost extrem de mică în comparație cu amploarea operațiunii Uber. Introducerea tehnologiei de recunoaștere facială de către industrie a fost complet disproporționată în raport cu riscul perceput. Cu toate acestea, cerința de identificare în timp real a devenit o condiție a reînnoirii licenței Uber la Tribunalul de Magistrați din Westminster în septembrie 2020.

În cazul Uber, atât conducerea platformei, cât și TfL nu au reușit să se asigure că au fost instituite garanții adecvate pentru a proteja drepturile și libertățile șoferilor, deși TfL a revizuit evaluarea impactului privind protecția datelor pentru tehnologie în martie 2020. Am făcut o libertatea de informare a solicitat TfL să aibă acces la DPIA Uber pentru sistemele de identificare în timp real, dar ni s-a refuzat. Potrivit rapoartelor TfL , 94% dintre șoferii de vehicule private de închiriat (PHV) provin din medii de culoare și minorități etnice, iar introducerea acestei tehnologii, care este bine recunoscută pentru ratele sale scăzute de precizie în cadrul acestor grupuri , sa dovedit dezastruoasă pentru lucrătorii vulnerabili deja în angajare precară.

Bolt a anunțat de atunci că investește 150 de milioane de euro în sisteme de detectare antifraudă a driverelor AI, inclusiv recunoașterea facială. Deliveroo a anunțat că și ei vor introduce verificări de identitate prin recunoaștere facială. Ola Cabs a lansat, de asemenea, identificarea prin recunoaștere facială ca o caracteristică a sistemului său Guardian, încorporând învățarea automată despre care susțin că le permite „să învețe continuu și să evolueze din milioane de puncte de date în fiecare zi, pentru a îmbunătăți semnalizarea riscurilor și rezoluția instantanee”.

FreeNow, un joint venture Daimler și BMW, supraveghează îndeaproape șoferii ca parte a programului lor de prevenire a fraudelor. Într-adevăr, documentele depuse de FreeNow la Înalta Curte în cadrul unei revizuiri judiciare a deciziei TfL de a le acorda un permis la Londra, aceștia au dezvăluit că TfL a făcut rapoarte lunare de concedieri ale șoferilor din diverse motive (inclusiv „activitate frauduloasă”) o condiție a acestora. reînnoirea recentă a licenței. Dar descrierea datelor prelucrate în scopul prevenirii fraudei ridică mai multe întrebări decât răspunde politica de confidențialitate a FreeNow.

În acest document, Free Now afirmă că folosesc un algoritm de „pădure aleatoare” pentru a produce un scor de fraudă pe care îl folosesc pentru a „ prioritiza călătoriile expediate în consecință. Acest lucru asigură o expediere corectă și cu riscuri minime .” Free Now a contestat utilizarea acestui sistem de detectare a fraudei atunci când ne-am întrebat despre acesta în iunie 2021, susținând că această secțiune a politicii de confidențialitate a fost depășită (vă rugăm să consultați studiul de caz al companiei în secțiunea II a raportului.) Cu toate acestea, descrierea acestui sistem a rămas în politică, în ciuda unei actualizări făcute în septembrie 2021.

Ceea ce este deosebit de îngrijorător cu privire la utilizarea acestor sisteme este că ele combină managementul fraudei cu managementul performanței. Faptul că astfel de indicatori de „fraudă” sunt utilizați ca variabile pentru alocarea muncii și că comportamentele care le generează pot continua pe platformă demonstrează că acestea nu sunt cazuri de fraudă criminală, ci mecanisme de control, care evaluează cât de bine se desfășoară lucrătorii. față de valorile opace stabilite de companii. Sugerăm că orice terminologie de „fraudă” utilizată în aceste contexte funcționează, de asemenea, ca parte a jocului de clasificare greșită, menită să ascundă relația de muncă.

Studiu de caz de supraveghere I: Eșecul recunoașterii faciale

În aprilie 2020, Uber a introdus un sistem de verificare a ID-ului în timp real (RTID) în Regatul Unit, care utilizează o combinație care include recunoașterea facială și verificarea locației pentru a autentifica identitatea șoferului și pentru a încerca să împiedice șoferii să partajeze accesul la contul lor pentru serviciu.

Sistemul RTID încorporează utilizarea API-ului Microsoft FACE, software-ul de recunoaștere facială și solicită șoferilor și curierilor să facă în mod obișnuit selfie-uri în timp real pentru a continua să utilizeze aplicația Uber. Fotografia este apoi verificată cu fotografia de profil a contului șoferului (și, în unele jurisdicții, cu bazele de date publice pentru a „ preveni împrumutul identității sau pentru a verifica identitățile utilizatorilor ”).

Pa Edrissa Manjang lucra cu Uber de aproximativ un an când a fost dezactivat din cauza unei eșecuri de verificare a selfie-urilor. În timp ce șoferii și curierii Uber oferă în mod obișnuit selfie-uri, acestea nu sunt stocate pe telefoanele lucrătorilor și nu pot păstra dovezile trimiterilor lor. Tatăl nu a primit niciun avertisment sau a fost notificat cu privire la nicio problemă până la demitere; sistemul de verificare a ID-ului în timp real a părut să aprobe toate fotografiile sale cu o verificare verde.

După concedierea sa, Pa a trimis numeroase mesaje către Uber pentru a remedia problema, cerând în mod special unui om să-și revizuiască trimiterile. De fiecare dată când i s-a spus lui Pa „nu am putut să confirmăm că fotografiile furnizate erau de fapt cu tine și, din cauza nepotrivirilor continue, am luat decizia finală privind încheierea parteneriatului nostru cu tine”. Am obținut selfie-urile în cauză printr-o cerere de acces la subiect, care a dezvăluit că toate fotografiile pe care Pa le-a trimis sunt de fapt ale lui. Aceasta a fost prima instanță în care am reușit să obținem selfie-urile depuse de un curier sau șofer. Nu este clar de ce această solicitare a reușit atunci când multe înainte nu au reușit.

De asemenea, am scris Microsoft la începutul anului pentru a ne exprima îngrijorările cu privire la utilizarea nereglementată de către Uber a API-ului FACE pe platforma sa. Ca răspuns , Microsoft a subliniat că toate părțile implicate în implementarea unor astfel de tehnologii au responsabilități care includ: „incorporarea unei analize umane semnificative pentru a detecta și rezolva cazurile de identificare greșită sau alte erori” și „să ofere sprijin persoanelor care cred că rezultatele lor au fost incorecte și să identifice și să abordeze fluctuațiile de acuratețe din cauza variației condițiilor.” Cazul lui Pa demonstrează clar că aceste verificări cruciale nu au fost implementate în procesarea imaginilor RTID.

Pa aduce acum un dosar împotriva Uber pentru a contesta implementarea sa de recunoaștere facială discriminatorie din punct de vedere rasial, reprezentată de Bates Wells, cu sprijinul Comisiei pentru Egalitate și Drepturile Omului, Sindicatul șoferilor și curierii pentru aplicații și Bursa de informații pentru lucrători.

EMBED: Videoclipul tatălui

Studiu de caz de supraveghere II: Verificări de geolocalizare

În timp ce utilizarea sistemelor de recunoaștere facială defecte este, fără îndoială, problematică, am văzut, de asemenea, mulți șoferi concediați după acuzații false de la Uber că s-au implicat în partajarea frauduloasă a contului, după ce două dispozitive au fost detectate de Uber în două locații în același timp. În toate cazurile pe care le-am analizat, am constatat că problema este legată de faptul că șoferul a instalat aplicația pe două dispozitive pentru confort, dar cu doar unul dintre dispozitive autentificat pentru lucru.

Chiar înainte de ora 20:00 pe 11 septembrie 2020, iar Aweso Mowlana lucra pentru Uber în sudul Londrei. Era un șofer cotat cu 4,95 stele, care a efectuat peste 11.500 de călătorii în peste 5 ani, lucrând pentru Uber. Aweso tocmai lăsase un pasager lângă Elephant and Castle când s-a deconectat pentru o scurtă pauză. La fel ca multe drivere, Aweso instalase aplicația pe un al doilea dispozitiv, care era un iPhone. În această seară, el părăsise iPhone-ul acasă și lucra cu celălalt telefon al său, un Samsung.

La 20:02, Aweso a încercat să se conecteze din nou la aplicația Uber pentru a se face disponibil pentru următoarea sa slujbă. Înainte de a i se permite să se conecteze din nou, i s-a cerut să ofere un selfie ca parte a Verificării identității în timp real (RTID) al Uber. Fotografia lui se potrivea cu fotografia de referință a Uber, așa că a finalizat cu succes procedura de conectare pentru a-și continua tura. Dar, fără să-i știe, sistemele Uber fie detectaseră și/sau trimiseseră ping al doilea telefon al său. Fiul său ridicase din greșeală al doilea telefon și îl luase cu el acasă la prietena lui din Uxbridge. Ulterior, Uber a spus că a solicitat o verificare RTID de pe acest dispozitiv la ora 20:03, dar până atunci Aweso era deja online în sudul Londrei. Uber susține că răspunsul la verificarea de identitate a fost trimis de pe iPhone în jurul orei 23:55 în acea seară.

A doua zi, Uber l-a informat că contul său a fost „semnalizat pentru activitate suspectă de aplicație” și că acum contul său va fi suspendat în timp ce „o echipă specializată examinează acest lucru”. Un timp mai târziu, Uber l-a respins definitiv pe Aweso prin mesaj text, spunând că „au găsit dovezi care indică o activitate frauduloasă” în contul său. Uber a susținut apoi că a partajat accesul la contul său și că, făcând acest lucru, a încălcat termenii și condițiile. Luna următoare, Transport for London a revocat imediat licența lui Aweso, pe motiv că nu mai putea fi găsit „apt și adecvat” pentru a deține o licență publică, pe motivul demiterii sale de la Uber.

Worker Info Exchange a asistat Aweso să facă o cerere de acces la subiect și să analizeze datele primite. Un fișier numit „D river Detailed Device Data ” înregistrează cel puțin o parte din fluxul de date de la dispozitive către Uber în timp real. Politica de confidențialitate a Uber indică faptul că acolo unde un dispozitiv are aplicația deschisă în fundal sau în prim-plan, chiar dacă nu este online și gata să accepte tarife. În mai mult de o duzină de cazuri în care am susținut contestația șoferilor la revocarea lor la Tribunalul de Magistrați, fiecare contestație a fost admisă și TfL a primit ordin să reintegreze permisele. Din acest fișier am putut vedea până la 230 de rânduri de date pe minut înregistrate de Uber de pe dispozitive. Sunt incluse datele colectate de Uber de pe dispozitivele Aweso locația geografică, nivelul bateriei, viteza, titlul cursului, numărul IMEI etc.

Datele au arătat că dispozitivul din Uxbridge nu a fost niciodată conectat pentru lucru în acea zi, deoarece un câmp intitulat „driver_online” arăta iPhone-ul ca „FALSE” în orice moment în acea zi, inclusiv ora în care a fost înregistrat la Uxbridge. Aceasta este dovada că dispozitivul nu a fost partajat pentru lucru cu alții, așa cum pretindeau Uber și Transport for London. Uber nu a reușit să ofere acces la datele personale procesate în ambele verificări RTID, inclusiv la fotografiile colectate. „Date detaliate despre dispozitiv” nu arată nicio înregistrare a vreunei activități suplimentare pentru iPhone după ora 20:03:43. Nu am văzut nicio dovadă de date privind activitatea dispozitivului la ora 23:55, când Uber a declarat că a primit un răspuns la verificarea de identificare emisă anterior.

Experiența lui Pa și Aweso a fost foarte răspândită în cursul anului trecut și a constituit un volum semnificativ de lucru gestionat de Worker Info Exchange și App Drivers & Couriers Union. În Londra, Transport for London a avut tendința de a retrage imediat licențele șoferilor despre care se spune că nu au reușit verificările RTID ale Uber, în ciuda problemelor evidente cu sistemul. Există adesea explicații rezonabile pentru utilizarea mai multor dispozitive, care sunt clasificate automat drept fraude. Politica de confidențialitate a Uber indică faptul că acolo unde un dispozitiv are aplicația deschisă în fundal sau în prim-plan, chiar dacă nu este online și gata să accepte tarife. În mai mult de o duzină de cazuri în care am susținut contestația șoferilor la revocarea lor la Tribunalul de Magistrați, fiecare contestație a fost admisă și s-a dispus repunerea permiselor TfL.

Worker Info Exchange, Big Brother Watch și App Drivers & Couriers Union au scris o scrisoare comună primarului Londrei pentru a ne exprima îngrijorările cu privire la încrederea Transport for London pe dovezi viciate de la Uber în luarea unei decizii de revocare și au cerut ca, în calitate de președinte al Transporturilor pentru consiliul de administrație al Londrei, să ordone o revizuire a tuturor acestor revocări greșite. Până în prezent, nici primarul, nici TfL nu au răspuns.

Managementul performanței opace

Opacitatea companiilor cu platforme inhibă angajații să înțeleagă cum ar putea fi integrat controlul algoritmic pe parcursul proceselor critice și în timp. De exemplu, lucrătorilor nu li sa oferit transparența la care au dreptul legal pentru a înțelege modul în care profilarea performanței se leagă de calitatea și cantitatea muncii oferite, precum și de randamentele așteptate pentru o astfel de muncă.

În cazul Ola, avem anumite cunoștințe despre categoriile de date pe care le colectează și le prelucrează în sistemele lor de alocare a muncii - cum ar fi scorurile probabilității de fraudă, profilul câștigurilor, istoricul de acceptare a rezervărilor și anulări, printre altele - cu toate acestea, acest lucru nu dezvăluie diferitele ponderi. aplicate acestor variabile, nici logica prelucrării.

Uber a susținut de mult timp că sistemul său de potrivire este determinat doar de locație, în ciuda interfeței sale „Partener-Driver” sugerând altfel. Programul Uber Pro (în care șoferii sunt înscriși automat pentru a putea fi stimulați să atingă obiectivele de performanță în schimbul beneficiilor și recompenselor) îi informează pe șoferi într-un limbaj vag că „ratele mai mari de confirmare înseamnă timpi de așteptare mai scurti pentru clienți și timpi mai scurti de preluare pentru toți. șoferi” făcând aluzie vag la faptul că scăderea locurilor de muncă va duce la mai puține oferte de locuri de muncă.

Uber a oferit doar recent mai multă transparență asupra sistemului de potrivire printr-o actualizare a politicii de confidențialitate care spune: „Utilizatorii pot fi potriviți în funcție de disponibilitate, proximitate și alți factori, cum ar fi probabilitatea de a accepta o călătorie pe baza comportamentului sau preferințelor lor din trecut”. dar, la momentul redactării, linkul care oferă informații suplimentare despre sistemul de potrivire este întrerupt, atestând caracterul evolutiv al unei astfel de prelucrări de date. O solicitare recentă privind libertatea de informare pe care am făcut-o către TfL, întrebând ce actualizări a furnizat Uber asupra sistemului său de potrivire (așa cum este obligat să facă atunci când face modificări la modelul său de operare) nu a dat niciun rezultat, evidențiind și mai mult înfundarea practicilor sale de management algoritmic. și absența supravegherii reglementare.

Dezvăluirile recente cu privire la variabilele care determină alocarea muncii ridică și întrebări importante cu privire la calitatea locurilor de muncă oferite șoferilor. Li se oferă șoferilor cu rate ridicate de acceptare a locurilor de muncă călătorii de durată și durată mai lungă, care rezultă în salarii mai mari, pe baza unui profil similar? Sau, mergând cu un pas mai departe, șoferilor li se oferă tarife diferite prin sistemul dinamic de prețuri? Într-adevăr, dacă și cum prețurile algoritmice sunt combinate cu alocarea muncii este o problemă sensibilă despre care se cunosc încă puține.

În ultimii ani, Uber a înlocuit prețurile variabile de timp și distanță pentru clienți pentru un model de preț fix în care un preț inițial este acceptat la începutul unei călătorii. Uber afirmă că „prețurile inițiale sunt dinamice, ceea ce înseamnă că prețul este stabilit în timp real pentru a ajuta la echilibrarea cererii și ofertei”. Mai recent, șoferii au raportat că li se oferă tarife foarte mici pentru locuri de muncă individuale. Există o oportunitate evidentă aici pentru Uber de a-și crește cota din eventualul tarif plătit de pasageri. Au fost ridicate îngrijorări cu privire la rezultatele discriminatorii ale utilizării acestor sisteme de prețuri dinamice asupra pasagerilor, ceea ce introduce perspectiva că șoferii ar putea fi, de asemenea, supuși unor prețuri personalizate în timp real. Există probleme etice serioase aici, dacă operatorii oferă prețuri mai mici lucrătorilor vulnerabili, pe baza unui profil care prezice disponibilitatea lor de a accepta munca la prețuri diferite.

În Regatul Unit, astfel de practici par să contravină prevederilor secțiunii 1 din Employment Rights Act, care dă dreptul lucrătorilor să primească de la angajator o declarație clară cu privire la condițiile de muncă, inclusiv ratele salariale.

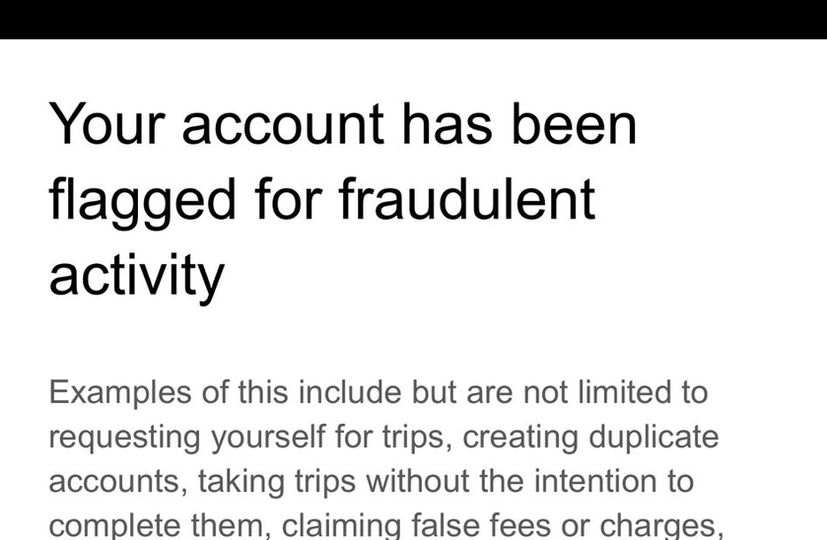

Studiu de caz: Control algoritmic

Uber trimite în mod obișnuit șoferilor mesaje atunci când sunt semnalați de sistemele sale de detectare a fraudei pentru a-i avertiza că își pot pierde locul de muncă dacă continuă orice comportament declanșează sistemul. Mesajele conțin o listă neexhaustivă a potențialilor declanșatori, dar nu oferă un motiv specific șoferului individual care este acuzat de fraudă. Când Alexandru a primit al doilea și ultimul dintre aceste mesaje, știind că un alt steag ar avea ca rezultat demitere, a decis să sune echipa de asistență pentru șoferi pentru a obține mai multe detalii despre motivul pentru care declanșează sistemul antifraudă și ce ar putea face pentru a-l evita. . Prin apel , Alexandru și agentul de asistență au discutat despre o varietate de situații care ar fi putut face ca călătoriile sale să pară neregulate, dezvăluind capacitatea limitată pe care o au echipele de suport în descifrarea indicațiilor făcute de sistem. La trei luni după acest apel, Uber a trimis un mesaj de scuze în care afirmă că i-au fost trimise avertismentele din greșeală.

Deși conversația este lămuritoare în ceea ce privește înțelegerea dilemelor cu care se confruntă șoferii atunci când politica companiei și cerințele pasagerilor diferă, ne-a interesat în mod deosebit discuția (25 de minute de la convorbire) referitoare la o ocolire pe care Alexandru l-a luat din cauza lucrărilor rutiere, precum și la nivelul scăzut al acestuia. ratele de acceptare a locurilor de muncă ca cauze potențiale ale detectării acestuia de către sistemul antifraudă. În urma deciziei Curții Supreme care ia clasificat pe șoferii Uber drept lucrători la începutul acestui an, Uber a susținut că a făcut modificări semnificative platformei sale, cum ar fi oferirea de transparență a prețului și destinației, precum și eliminarea măsurilor punitive pentru refuzul de locuri de muncă, în încercarea de a argumenta că decizia Curții Supreme nu s-a aplicat actualilor șoferi Uber.

Experiența lui Alexandru pe platformă contravine acestei narațiuni, deoarece devine evident că el este probabil semnalat pentru abaterea de la rută (în ciuda faptului că Uber operează acum un model de preț fix, ceea ce înseamnă că șoferii fac astfel de modificări de rutare pe cheltuiala lor) și neacceptarea suficientă din munca care i se oferea pe peron. Acest apel arată clar că, în practică, șoferii sunt încă la fel de strâns controlați de Uber ca înainte.

Pe lângă aceste practici de management, programul Pro menționat mai sus este un alt instrument pe care Uber îl folosește pentru a-și exercita controlul asupra forței de muncă, eludând în același timp obligațiile legale care pot fi asociate cu un astfel de control. De exemplu, legând anumite recompense care culminează din menținerea unui rating ridicat față de companiile terțe sau prezentând participarea la beneficiile de preț ca fiind pur opțională prin înclinare comportamentală, Uber creează iluzia de a lăsa șoferii să opereze cu independență și flexibilitate deplină. Presupusul angajament voluntar al șoferilor în aceste programe are ca rezultat renunțarea la drepturile rezultate din deținerea unei relații de muncă.

EMBED: Videoclipul lui Alexandru

Extinderea infrastructurii de aplicare a legii

Există, de asemenea, dovezi că platformele au devenit din ce în ce mai mult o sursă atractivă de informații pentru poliție și serviciile de securitate. Într-o declarație de martor prezentată ca probe în septembrie 2020 la apelul Uber pentru acordarea licenței la Tribunalul de Magistrați din Westminster, directorul general al Uber din Regatul Unit și Europa de Vest, Jamie Heywood, a atestat o relație din ce în ce mai strânsă cu poliția și serviciile de securitate. Printre acestea se numără Rețeaua Națională de Luptă împotriva Terorismului de Poliție, SO15 - Comandamentul Antiterorism al Serviciului de Poliție Metropolitană, Consiliul șefilor de poliție națională (NPCC), Colegiul de Poliție, Agenția Națională pentru Crimă și Poliția de Transport britanică. Un domeniu de cooperare a fost problema așa-numitelor transporturi de droguri pe liniile județene. Citându-l pe inspectorul detectiv Stuart Liddell de la NPCC, Heywood a mărturisit despre o relație de maturizare bazată pe niveluri sofisticate de partajare a informațiilor:

„Sunt încurajat de angajamentul manifestat de Uber cu privire la această chestiune și sunt planificate lucrări suplimentare [în 2020] pentru a continua munca de până acum. Acest lucru se va concentra pe aspecte mai complicate ale liniilor județene, fluxul de informații și informații și consolidarea relației dintre Centrul național de coordonare a liniilor județene.”

Într-adevăr, NPCC a făcut lobby pe comisarul pentru Transport pentru Londra, Mike Brown, în sprijinul contestației privind licența Uber. Șeful polițist Mark Collins a mers chiar atât de departe încât a sugerat că o decizie de a refuza licența Uber ar putea avea un impact negativ asupra poliției din Regatul Unit.

„Sperăm că această scrisoare subliniază impactul negativ asupra poliției din Regatul Unit în cazul în care poliția nu ar putea accesa datele și informațiile pe care le-am descris.”

De asemenea, Heywood a mărturisit că Collins a susținut că numai Serviciul de Poliție Metropolitană a făcut peste 2.000 de solicitări de date către Uber în fiecare an. Acesta este un număr relativ mare de solicitări, având în vedere că, conform raportului de transparență al Uber, în 2020, toate autoritățile americane de aplicare a legii au făcut împreună puțin sub 5.000 de solicitări de date, iar toate autoritățile canadiene de aplicare a legii au făcut împreună doar 411 astfel de solicitări.

Este probabil ca conducerea Uber să simtă presiunea de a coopera cu inițiativele de colectare a informațiilor poliției, în special în lumina deciziei Transport for London de a refuza reînnoirea licenței de două ori. Acest lucru se datorează faptului că secțiunea 17 din Actul Crime and Disorder din 1998 pune o responsabilitate directă autorităților de acordare a licențelor pentru a preveni criminalitatea și dezordinea în zona lor. Aceasta instituie o cerință ca autoritățile de acordare a licențelor, cum ar fi Transport for London, să stabilească parteneriate pentru reducerea criminalității și a tulburărilor (CDRP) la care se așteaptă să participe operatorii de transport precum Uber.

În ghidul statutar al Departamentului pentru Transport pentru autoritățile de acordare a licențelor, guvernul întărește așteptările privind schimbul de informații între poliție, autoritățile de acordare a licențelor și operatorii de transport, cum ar fi Uber:

„Creșterea gradului de conștientizare în rândul forțelor de poliție cu privire la valoarea pe care autoritățile de acordare a licențelor o acordă informațiilor primite, în special cu privire la informațiile necondamnare, va ajuta la promovarea acestor relații și va consolida beneficiile unui schimb mai mare de informații. Această relație poate fi reciproc avantajoasă, ajutând poliția în prevenirea criminalității. Poliția poate obține informații valoroase de la șoferi și operatori...”

Deși astfel de relații au o importanță semnificativă pentru controlul criminalității la nivel comunitar, se pare că s-a acordat puțină atenție riscului pentru libertățile civile aferente unui acces relativ ușor la datele personale bogate ale șoferilor și pasagerilor, așa cum sunt colectate și stocate de platforme precum Uber, Bolt și Ola. Taxiuri.

„Sunt încurajat de angajamentul manifestat de Uber cu privire la această chestiune și sunt planificate lucrări suplimentare [în 2020] pentru a continua munca de până acum. Acest lucru se va concentra pe aspecte mai complicate ale liniilor județene, fluxul de informații și informații și consolidarea relației dintre Centrul național de coordonare a liniilor județene.”

„Sperăm că această scrisoare subliniază impactul negativ asupra poliției din Regatul Unit în cazul în care poliția nu ar putea accesa datele și informațiile pe care le-am descris.”

„Creșterea gradului de conștientizare în rândul forțelor de poliție cu privire la valoarea pe care autoritățile de acordare a licențelor o acordă informațiilor primite, în special cu privire la informațiile necondamnare, va ajuta la promovarea acestor relații și va consolida beneficiile unui schimb mai mare de informații. Această relație poate fi reciproc avantajoasă, ajutând poliția în prevenirea criminalității. Poliția poate obține informații valoroase de la șoferi și operatori...”

Studiu de caz: Partajarea informațiilor cu forțele de ordine

Un alt lucrător care ne-a contactat pentru ajutor a fost un șofer Uber care a fost suspendat pe nedrept de pe platforma Uber timp de șapte săptămâni, înregistrând o pierdere de aproape 5000 de lire sterline, în urma unei cereri de informații făcute de poliție. În 2019, șoferul a primit un mesaj de la Uber în care se spunea că a fost suspendat temporar din cauza unei anchete în desfășurare. Nu i s-a dat nici un motiv, nici un termen pentru suspendarea sa. De fapt, i s-a spus în mod expres să nu contacteze Uber în timp ce ei derulau ancheta. Șapte săptămâni mai târziu, a primit un apel prin care îl informa că acum poate lucra.

Doi ani mai târziu, o cerere de reînnoire a permisului pe care șoferul a făcut-o către TfL (care include o verificare îmbunătățită a Serviciului de Dezvăluire și Barring) a dezvăluit motivul suspendării, când TfL l-a interogat despre furnizarea de droguri în 2019 și l-a amenințat că îi va lua permisul. Șocat de dezvăluire, șoferul a cerut un număr de referință al infracțiunii și a făcut alte anchete nu doar la TfL, ci și la Poliția Metropolitană.

L-am asistat pe șofer să facă cereri de acces și plângeri către Uber, TfL și poliție. Uber nu a reușit să îndeplinească cererea (șoferul a fost informat că solicitarea sa a fost transmisă unei echipe de specialiști, dar nu a primit niciun răspuns suplimentar), cu toate acestea, răspunsul TfL a descoperit un lanț extins de e-mailuri între diverși oficiali în timp ce încercau să identifice sursa informațiilor. cerere. Uber a susținut că au fost abordați de poliție, în timp ce poliția nu a găsit nicio înregistrare sau dovezi de investigare a șoferului. În cele din urmă, Uber l-a numit pe ofițerul care a făcut cererea de informații, dar când TfL a căutat detalii despre caz, OIC a susținut că nu își amintește despre șoferul în cauză.

Plângerea adresată de șofer la Poliția Metropolitană a primit în sfârșit răspuns în octombrie 2021 și a concluzionat că șoferul nu a fost niciodată identificat ca suspect:

„Ofițerii au fost însărcinați să identifice un suspect în legătură cu o infracțiune gravă. Ofițerilor li s-a transmis numele unei persoane de interes. Pot să confirm că NU ai fost tu. Un formular de protecție a datelor a fost trimis la 20 februarie 2019 la Uber cu aceste detalii suspecte numite. Nu am libertatea de a dezvălui alte detalii despre asta.

„În niciun moment nu a apărut numele tău în această anchetă de cercetare făcută cu Uber. Ofițerul NU a abordat Uber căutând informații legate de tine. Ca urmare a anchetei noastre, Uber a furnizat poliției datele dumneavoastră. Odată ce informațiile au fost primite înapoi de la Uber și ne-au dat numele dvs., am știut că NU aveți legătură cu investigația noastră și nu au fost luate măsuri suplimentare și că ați fost exclus de la orice alte anchete.”

„Ofițerul nu a încălcat niciun standard profesional și nu a acționat în afara rolului său de ofițer de poliție sau a abuzat de puterea lor. Numele tău nu a fost scopul solicitării și în niciun moment nu i-am spus Uber că ești o persoană de interes.”

„Uber ar trebui să explice cum suspendă pe cineva care nu a făcut obiectul cererii inițiale și, de asemenea, de ce, după 10 zile, nu ați fost reinstalat automat în aplicație și nu ați putut continua să lucrați.”

EMBED: Video-ul lui L

„Ofițerii au fost însărcinați să identifice un suspect în legătură cu o infracțiune gravă. Ofițerilor li s-a transmis numele unei persoane de interes. Pot confirma că NU ai fost tu. Un formular de protecție a datelor a fost trimis la 20 februarie 2019 la Uber cu aceste detalii suspecte numite. Nu am libertatea de a dezvălui alte detalii despre asta.

„În niciun moment nu a apărut numele tău în această anchetă de cercetare făcută cu Uber. Ofițerul NU a abordat Uber căutând informații legate de tine. Ca urmare a anchetei noastre, Uber a furnizat poliției datele dumneavoastră. Odată ce informațiile au fost primite înapoi de la Uber și ne-au dat numele dvs., am știut că NU aveți legătură cu investigația noastră și nu au fost luate măsuri suplimentare și că ați fost exclus de la orice alte anchete.”

„Ofițerul nu a încălcat niciun standard profesional și nu a acționat în afara rolului său de ofițer de poliție sau a abuzat de puterea lor. Numele tău nu a fost scopul solicitării și în niciun moment nu i-am spus Uber că ești o persoană de interes.”

„Uber ar trebui să explice cum suspendă pe cineva care nu a făcut obiectul cererii inițiale și, de asemenea, de ce, după 10 zile, nu ați fost reinstalat automat în aplicație și nu ați putut continua să lucrați.”

Partea a II-a: Exercitarea drepturilor asupra datelor la locul de muncă: Acces

Legea muncii nu are prevederile necesare pentru a proteja pe deplin lucrătorii de practicile neloiale care decurg din managementul algoritmic. Cu toate acestea, persoanele fizice au drepturi în temeiul GDPR care le pot proteja interesele în contexte de angajare. În sprijinul lucrătorilor, invocăm drepturile acestora, astfel cum sunt definite de articolele 15, 20 și 22, care le conferă dreptul de a accesa datele cu caracter personal , dreptul la portabilitatea datelor , precum și dreptul de a fi informați cu privire la luarea automată a deciziilor și logica. de prelucrare .

Articolul 22: Persoanele vizate nu pot fi supuse unor decizii cu efecte juridice (sau similare semnificative), bazate exclusiv pe prelucrarea automată a datelor.

[Dacă operatorul de date prelucrează date cu consimțământul explicit al persoanei vizate sau pentru executarea unui contract cu aceasta, persoana vizată are dreptul de a obține intervenția umană, de a-și exprima punctul de vedere și de a contesta decizia]

Articolul 15: Persoanele vizate au dreptul de a primi o copie a datelor lor personale, împreună cu informații suplimentare, cum ar fi scopurile prelucrării datelor, informații despre cui pot fi partajate datele, durata prelucrării etc.

Articolul 20: Persoanele vizate au dreptul de a primi datele cu caracter personal pe care le-au furnizat unui operator într-un format structurat, utilizat în mod obișnuit și care poate fi citit automat. Ei au, de asemenea, dreptul de a transmite („porta”) datele unui alt operator. Acolo unde este posibil, aceștia pot cere ca datele să fie transmise direct de la un operator la altul.

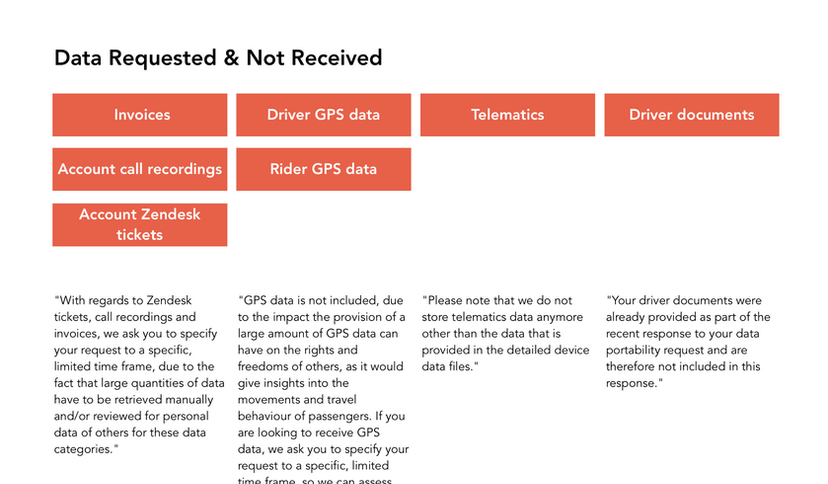

În timp ce platformele pun la dispoziția lucrătorilor descărcări de date, acestea omit frecvent categoriile de date cele mai favorabile și necesare pentru interogarea condițiilor de muncă (cum ar fi echitatea salariilor, alocarea locurilor de muncă și utilizarea, așa cum sunt enumerate mai sus). În aspirația noastră de a extinde domeniul de aplicare a date puse la dispoziția lucrătorilor, facem cereri specifice de acces și portabilitate pentru subiecte care acoperă întreaga gamă de platforme de date colectate de la aceștia. În aceste solicitări, căutăm să obținem trei tipuri diferite de date:

1) Date de intrare - furnizate de lucrătorii înșiși

2) Date de observare – bazate pe utilizarea platformelor de către lucrători (adică date brute de măsurare și supraveghere, cum ar fi datele de locație, telematică etc.)

3) Date deduse – derivate din analiza datelor de observație (de exemplu, profilarea comportamentului lucrătorilor sub formă de evaluări de risc și fraudă)

Articolul 22: Persoanele vizate nu pot face obiectul unor decizii cu efecte juridice (sau semnificative similare), bazate exclusiv pe prelucrarea automată a datelor.

[Dacă operatorul de date prelucrează date cu consimțământul explicit al persoanei vizate sau pentru executarea unui contract cu aceasta, persoana vizată are dreptul de a obține intervenția umană, de a-și exprima punctul de vedere și de a contesta decizia]

Articolul 15: Persoanele vizate au dreptul de a primi o copie a datelor lor personale, împreună cu informații suplimentare, cum ar fi scopurile prelucrării datelor, informații despre cui pot fi partajate datele, durata prelucrării etc.

Articolul 20 : Persoanele vizate au dreptul de a primi datele cu caracter personal pe care le-au furnizat unui operator într-un format structurat, utilizat în mod obișnuit și care poate fi citit automat. Ei au, de asemenea, dreptul de a transmite („porta”) datele unui alt operator. Acolo unde este posibil, aceștia pot cere ca datele să fie transmise direct de la un operator la altul.

Date de intrare

Furnizat de lucrătorii înșiși

Date observate

Pe baza utilizării de către lucrători a platformelor (adică date brute de măsurare și supraveghere, cum ar fi datele de locație, telematică etc.)

Date deduse

Derivat din analiza datelor de observație (de exemplu, profilarea comportamentului lucrătorilor sub formă de evaluări ale riscurilor și fraudei)

Aceste categorii de date sunt adesea explicite în documentele de orientare și politicile de confidențialitate, dar nu sunt partajate șoferilor atunci când își descarcă datele sau fac cereri de acces la subiect. Din experiența noastră, atunci când lucrătorii caută aceste informații, platformele de concerte urmăresc să facă procesul dificil și împovărător prin implicarea într-o varietate de comportamente neconforme. Lucrătorii care caută date complete trebuie să navigheze în arhitecturi de site-uri web extrem de complexe și obstructive și trebuie să evite eforturile suplimentare de frustrare ale agenților de asistență, care prelungesc în mod inutil procesele administrative simple sau oferă răspunsuri automate care nu răspund în mod adecvat la întrebări. Aceste proceduri pot fi descrise ca „ modele întunecate” concepute pentru a ghida lucrătorii să nu își exercite drepturile ca persoane vizate. În situațiile în care lucrătorii își pot obține datele, deseori fie lipsesc segmente considerabile, fie sunt prezentate în formate inconsistente și care nu pot fi citite de mașină, ceea ce face ca analiza să fie efectiv imposibilă. Aceste acte de obstrucție îi obligă pe lucrători să facă cereri repetate pe care companiile le folosesc în cele din urmă drept motiv pentru a le discredita.

În toate returnările DSAR pe care le-am văzut, niciun angajator nu a dat o evidență completă și corectă a prelucrării automate a datelor cu caracter personal. Acest lucru este deosebit de important în domeniile care pot determina securitatea angajării, cum ar fi alocarea muncii, managementul performanței, siguranța și securitatea, așa cum se discută în acest raport. Uber și Ola au susținut în instanță că siguranța și securitatea platformei lor pot fi compromise dacă logica unei astfel de prelucrări a datelor este dezvăluită lucrătorilor lor. În opinia noastră, siguranța și securitatea pot fi îmbunătățite doar atunci când platformele stabilesc în mod transparent reguli și standarde de performanță, mai degrabă decât să se bazeze pe supraveghere secretă și concedieri sumare, care sunt unii dintre motivele cheie ale DSAR.

Având în vedere această atitudine rezistentă față de DSAR, este, de asemenea, important de menționat că mulți șoferi se tem de represaliile companiilor pentru a face cereri. Atunci când platformele de concerte efectuează verificări nemoderate și prelungite de identitate ca răspuns la solicitările de acces la subiect, lucrătorii sunt ușor descurajați și intimidați (vezi e-mailurile trimise șoferilor de către Uber în studiile de caz privind răspunsul platformei). În numeroasele interviuri pe care le-am efectuat cu șoferii, mesajele îndelungate de căutare a confirmării, transmise într-un limbaj juridic complex, au fost adesea menționate ca elemente de descurajare pentru a urmări cererile. Pentru mulți șoferi, actul de a persista cu cererea echivalează cu a-și pune capul deasupra parapetului și a-și risca existența și siguranța locului de muncă.

Această percepție provine adesea din experiențele de exploatare continuă și insecuritate, ca urmare a capacității și cunoștințelor limitate ale lucrătorilor în exercitarea drepturilor democratice, fie în Marea Britanie, în calitate de imigranți, fie în țările lor de origine, care în multe cazuri prezintă tendințe autoritare. Într-o forță de muncă care este deja foarte fragmentată și predispusă la precaritatea economică, în care nevoia de securitate depășește cu mult dorința de a contesta nedreptatea, impactul acestui tip de comportament ostil al companiilor nu poate fi exagerat. Această nesiguranță este în plus agravată de opacitatea algoritmilor de management. În absența unor explicații clare cu privire la modul în care funcționează sistemele de alocare a muncii sau de management al performanței, devine foarte ușor pentru lucrători să se angajeze în gândire speculativă sau chiar conspirativă asupra modului în care interacțiunile lor cu platforma le afectează munca. Acest lucru se poate extinde apoi într-o neîncredere generalizată față de alte instituții și aversiune față de organizarea activității. Acestea sunt vulnerabilități puternice și persistente la nivelul forței de muncă care necesită o atenție și o protecție deosebită.

Studii de caz: DSAR-uri individuale

Următoarele studii de caz demonstrează câteva dintre modalitățile prin care Uber se angajează într-un comportament obstructiv și neconform în a răspunde solicitărilor de date ale lucrătorilor. În mod semnificativ, aceste exemple nu pot fi explicate ca excepții sau evenimente izolate privind agenții de asistență neexperimentați. Aceste răspunsuri reprezintă procedurile standard urmate de Uber atunci când lucrătorii doresc să își exercite drepturile de acces la date.

Răspunsuri circulare și zadarnice

M. Ahmed este fost șofer Uber și curier Uber Eats. În octombrie 2020, atât conturile de șofer Uber, cât și de curierat au fost suspendate, iar în februarie 2021, contul de șofer a fost dezactivat. Acest lucru i-a afectat și contul de curier UberEats, care a fost ulterior dezactivat și șters.

Când domnul Ahmed a cerut cauza concedierii, i s-au dat răspunsuri contradictorii. Uber a citat inițial verificările eșuate de recunoaștere facială, iar ulterior a susținut că dezactivarea s-a datorat unui volum mare de comenzi nelivrate. Pe tot parcursul corespondenței, i s-au adresat cu un nume greșit și, în cele din urmă, au acceptat că mesajele privind verificările eșuate în Real Time ID au fost trimise din greșeală. Confuzia din jurul concedierii l-a determinat să-și caute datele personale.

În ultimele luni, domnul Ahmed a încercat să recupereze datele asociate contului său Uber Eats dezactivat. Domnul Ahmed a încercat pentru prima dată să-și obțină datele pe 15 aprilie 2021, prin formularul „Trimiteți o întrebare privind confidențialitatea fără un cont Uber” de pe site-ul web Uber, deoarece contul său fusese șters după concedierea sa.

Ca răspuns, el a primit un e-mail de la Uber în care spunea: „Notificarea noastră privind confidențialitatea limitează capacitatea noastră de a partaja informații despre titularul contului. Putem furniza aceste informații numai prin procesul descris în instrucțiunile noastre de solicitare a datelor.” Acest proces se referă la conectarea în cont și efectuarea cererii din interiorul contului. „Aceasta fiind spuse, putem colabora cu dvs. prin canalele adecvate pentru a vă ajuta dacă este necesar.”

Dl Ahmed a scris înapoi cerând sfaturi despre cum ar putea accesa datele asociate cu contul său acum șters. El a explicat că scria din e-mailul asociat contului său Uber Eats și că a furnizat și numărul de mobil asociat acestui cont. El a adăugat că este bucuros să ofere informații suplimentare pentru a-și confirma identitatea.

La aceasta, domnul Ahmed a primit un răspuns în care se spunea că „îngrijorarea sa nu are legătură cu acest cont. Vă rugăm să ne scrieți din contul în cauză sau să vă conectați prin help.uber.com cu acreditările relevante și să ne informați despre problemă, astfel încât să vă putem ajuta în continuare.”

Domnul Ahmed a răspuns, atașând o imagine a e-mailului de înscriere trimis lui de Uber la 3 iulie 2020, pentru a demonstra că scria din contul relevant. La 19 aprilie 2021, el a primit același mesaj în care spunea că „preocuparea sa nu are legătură cu acest cont”.

Domnul Ahmed a răspuns, explicând încă o dată că nu își poate accesa contul și că a furnizat detaliile asociate contului său Uber Eats. El a cerut să primească îndrumări cu privire la ce alte informații ar putea furniza pentru a se identifica. Nu a primit niciun răspuns.

În acest moment, domnul Ahmed a căutat ajutor de la Sindicatul șoferilor și curieri de aplicații și de la Bursa de informații despre lucrători și am escaladat problema cu Uber. La 11 mai 2021, domnul Ahmed a primit un e-mail de la Uber în care i-a cerut să confirme cererea făcută în numele său de noi. Ne-a scris înapoi confirmând că ne-a dat mandatul și că ar dori ca cererea lui să fie procesată.

La 14 mai 2021, domnului Ahmed i s-a trimis de către Uber un formular de verificare a actului de identitate pentru a procesa cererea. Formularul i-a cerut aceleași detalii pe care le împărtășise deja în mesajele sale anterioare, cum ar fi e-mail, număr de telefon, țara de reședință, tipul de date solicitate. De asemenea, i-a cerut „evaluarea actuală” – care era inaplicabilă, deoarece nu mai avea acces la contul său. Domnul Ahmed a trimis formularul către Uber, dar nu a primit niciun răspuns.

La 20 mai 2021, domnul Ahmed a scris lui Uber pentru a obține confirmarea că procesează cererea lui. Nu a primit niciun răspuns.

La momentul redactării acestui articol, domnul Ahmed nu a primit datele sale. Nici nu i s-a dat nicio explicație cu privire la motivul pentru care cererea sa nu este procesată.

Partajarea inconsecventă și incrementală a datelor

Domnul Amini este un fost șofer Uber care a fost dezactivat în noiembrie 2020 în urma unei verificări eșuate de geolocalizare . Uber a raportat concedierea lui la TfL, care apoi i-a retras licența de închiriere privată a domnului Amini, lăsându-l fără muncă. În încercarea de a înțelege cauza concedierii sale, domnul Amini a căutat să obțină datele sale de la Uber.

Domnul Amini a făcut prima sa cerere la 13 aprilie 2021 și a cerut toate datele sale personale, inclusiv cele 26 de categorii de date prezentate în documentul de orientare produs de Uber, precum și imaginile trimise de acesta ca răspuns la verificările de identificare în timp real. El a precizat că a dorit date care să acopere întreaga perioadă în care a fost activ ca șofer Uber.

Domnul Amini a primit un răspuns la cererea sa la 5 mai 2021, cu toate acestea, datele furnizate au acoperit doar cele 30 de zile anterioare solicitării sale. Întrucât domnul Amini nu a putut lucra pentru Uber în această perioadă, multe dintre seturile de date furnizate erau goale.

Domnul Amini a făcut apoi o altă solicitare la 6 mai 2021, declarând încă o dată că solicită date referitoare la întreg intervalul de timp în care a lucrat cu Uber, adăugând în mod special că dorește date colectate până în noiembrie 2020.

Domnul Amini a primit un răspuns la 28 mai 2021. Cu toate acestea, i s-au trimis din nou date incomplete. Mai exact, fișierul csv cu datele detaliate despre dispozitive furnizat de Uber era complet gol.

Domnul Amini a făcut o altă solicitare la 02 iunie 2021 cerând datele lipsă. El a primit Datele detaliate despre dispozitiv pentru șofer pentru noiembrie 2020 pe 10 iunie 2021. Cu toate acestea, în ciuda faptului că a specificat că dorește toate câmpurile de date enumerate în notele de orientare produse de Uber, i s-a trimis un set de date restricționat care a omis 32 din cele 50 de date. câmpuri.

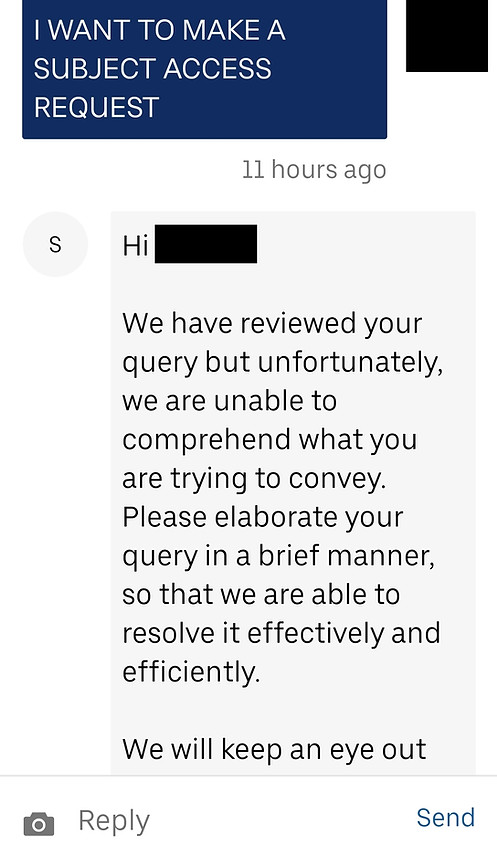

Ofucare și rezistență

Domnul Majid este un fost șofer Uber care a fost dezactivat în septembrie 2020 în urma unei verificări eșuate de geolocalizare. Ca și în cazul domnului Amini, Uber a raportat la TfL concedierea domnului Majid, ceea ce a determinat revocarea licenței sale de închiriere privată. În efortul de a înțelege baza acuzațiilor Uber, a încercat să-și obțină datele.

Domnul Majid a contactat pentru prima dată Uber pentru a-și solicita datele pe 2 iunie 2021. Ca răspuns, a primit un mesaj prin care i-a cerut să-și dezvolte îngrijorarea într-un mod scurt. Dl Majid a răspuns cu cererea pentru 3 categorii de date (din cele 26 de categorii enumerate în notele de orientare ale Uber) pentru septembrie 2020.

La 8 iunie 2021, domnul Majid a primit un mesaj de la Uber în care spunea: „Politica noastră de confidențialitate nu ne permite să facem modificări sau să discutăm despre informații personale fără contact prin adresa de e-mail asociată contului partener. Pentru a vă ajuta cu problema dvs. specifică, va trebui să scrieți folosind adresa de e-mail asociată contului respectiv. Mulțumesc pentru înțelegere."

În această etapă, domnul Majid ne-a contactat, confuz, deoarece scrisese lui Uber din contul său. El a răspuns, explicându-i lui Uber că i-a contactat conectându-se la contul său de șofer, așa că cu siguranță scria de la adresa de e-mail corectă. El a întrebat dacă poate furniza vreo identificare/documentație suplimentară pentru a-i asigura pe Uber că el este cel care a făcut cererea.

Ca răspuns, a primit același mesaj de la Uber: „Bună... mulțumesc pentru mesaj. Înțelegem că doriți să discutați despre informații legate de un cont Uber. Dacă sunteți titularul contului, vă rugăm să scrieți de la adresa de e-mail asociată contului dvs. Partner-Driver și vă vom putea ajuta imediat.”

La 9 iunie 2021, domnul Majid s-a conectat la contul său de partener și a început o conversație cu asistența Uber pentru a încerca din nou. Mesajul său prin care se întreba dacă ar putea face o cerere de acces la subiect a fost ignorat.

La 14 iunie 2021, domnul Majid a contactat din nou Uber, declarând că avea o întrebare despre contul său de partener de șofer. El a primit un răspuns de la Uber: „Vă mulțumim că ne-ați contactat... Am profitat de ocazie pentru a vă analiza îngrijorarea și putem vedea că ne-ați contactat anterior în legătură cu această problemă. Unul dintre membrii echipei noastre investighează în prezent problema dvs. și vă vom contacta cât mai curând posibil. Pentru a ne eficientiza comunicarea și a evita orice confuzie, vom închide acest contact.”

La 16 iunie 2021, domnul Majid a contactat din nou Uber, declarând că i s-a cerut să se conecteze la contul său pentru a face o solicitare și, după ce a făcut acest lucru, a dorit să împărtășească detaliile cererii sale. El a primit un răspuns în ziua următoare și, ulterior, a trimis detalii despre cerere (dintre cele trei seturi de date enumerate mai sus) la 18 iunie 2021.

După ce nu a primit niciun răspuns, domnul Majid a contactat din nou Uber pe 28 iunie 2021, cerând confirmarea faptului că cererea sa era în curs de procesare. La 1 iulie 2021, a primit un răspuns în care se spunea că îngrijorarea sa a fost exprimată echipei de specialitate și că vor lua legătura pentru a investiga în continuare.

La 2 iulie 2021, domnul Majid a primit un răspuns la firul de mesaje pe care l-a inițiat la 09 iunie 2021. Acest mesaj spunea că Uber solicită ca cererile să fie transmise personal la adresa poștală a Uber BV din Țările de Jos.

Domnul Majid nu a primit nicio altă comunicare.

„Întrebarea algoritmilor este centrală pentru tema uberizării. De prea multe ori, algoritmul este cel care joacă adevăratul rol al șefului, întrucât tehnologia oferă noi mijloace pentru subordonarea lucrătorilor. Este evident că este nevoie de transparență a managementului algoritmic, dar dincolo de această transparență, este nevoie de co-management al algoritmului. Reprezentanții lucrătorilor trebuie să poată participa la dezvoltarea lor”.

Leïla Chaibi, europarlamentar

Studii de caz: Platform Responses to

Solicitări în loturi de la schimbul de informații despre lucrător

După cum demonstrează exemplele de mai sus, procesele individuale de solicitare pot fi extrem de consumatoare de timp și de capacitate. Prin urmare, am creat procese care să ne permită să facem cereri de loturi în numele șoferilor și să simplificăm această procedură complexă. Am creat un sistem care utilizează soluția de semnătură electronică și ID dezvoltată de Scrive pentru a primi un mandat legal de la lucrători să facă cereri în numele lor. Această soluție include, de asemenea, o verificare a ID-ului efectuată de Onfido (același serviciu de verificare a ID-ului folosit de Uber), pentru a ne asigura că atât noi, cât și operatorul de date putem fi siguri de identitatea solicitantului și păstrăm confidențialitatea datelor. Verificarea actului de identitate impune lucrătorilor să prezinte unul dintre următoarele documente de identitate: pașaport, permis de conducere, carte de identitate sau permis de ședere. Prin acest proces, pentru fiecare persoană este creat un document de consimțământ individual care este sigilat electronic și verificabil prin atașamente ascunse care conțin un jurnal de dovezi pentru a dovedi autenticitatea procesului de identificare. (Scrive oferă și un serviciu de verificare a integrității formularelor de consimțământ, care este legat în documente.) Trimitem aceste documente, împreună cu o foaie de calcul care conține numele, e-mailurile, adresele și numerele de telefon ale lucrătorilor care fac cereri.

Unele companii au fost adaptabile și cooperante în a răspunde solicitărilor făcute prin această procedură, în timp ce altele s-au angajat într-un comportament mult mai obstructiv și ostil. Cu toate acestea, chiar și atunci când companiile au dat curs solicitărilor, au existat probleme consistente în stabilirea categoriilor precise de date colectate, precum și în obținerea tuturor datelor solicitate într-un format structurat și care poate fi citit automat. Puține companii au reușit să furnizeze documente de îndrumare cu descrieri clare ale categoriilor de date, iar datele pe care le-am primit au arătat adesea incongruități semnificative cu procesarea descrisă în politicile de confidențialitate. În general, companiile au manifestat tendința de a nega practicile de date pe care nu doresc să le dezvăluie. Într-un caz, o companie a susținut că evaluarea fraudei la care se face referire în politica sa de confidențialitate a fost efectuată doar ca parte a unui proces și că politica de confidențialitate a fost depășită. Un altul ne-a îndrumat către un document despre care au susținut că l-a înlocuit pe cel pe care ne bazam cererea, deși ambele documente au fost actualizate la aceeași dată.

În ciuda acestor dificultăți, cea mai controversată respingere cu care ne-am confruntat a fost negarea dreptului nostru de a acționa în numele lucrătorilor atunci când facem cereri de acces subiecților în calitate de terță parte. Acest drept fără echivoc (exprimat în mod clar în ghidul ICO și chiar promovat de propunerea guvernului de reformă GDPR ) a fost pus sub semnul întrebării atât de Bolt, cât și de Uber. Deși este evident că rezistența acționează spre frustrarea procesului de solicitare, ea indică, de asemenea, o lacună importantă în ghidurile existente privind procesele de verificare a identității. Atunci când companiile insistă să efectueze verificări de identitate prin contact direct cu lucrătorii, supunându-i unei corespondențe complexe din punct de vedere juridic, acest lucru anulează în mare măsură scopul de a apela la terți pentru cereri. Există un conflict îngrijorător între drepturile părților respective aici, care necesită îndrumări de reglementare urgente pentru a se asigura că nu este abuzat și manipulat pentru a adânci asimetriile informaționale.

Deliveroo

Din cele șapte companii cărora le-am făcut solicitări, Deliveroo a fost cea mai conformă. În solicitările noastre, am solicitat companiilor să confirme data până la care se va răspunde la cerere și să proceseze cererile în bloc, informându-ne când se fac toate dezvăluirile individuale.

Deliveroo a răspuns solicitărilor în termenul legal, cu condiția: a document de orientare, adnotând în mod clar categoriile de date și comunicat cu noi pe parcursul procesului.

Liber acum

Free Now a îndeplinit cererea noastră în intervalul de timp estimat și a răspuns pe parcursul procesului, totuși, acolo am întâlnit câteva probleme care merită evidențiate.

1) Free Now a încercat inițial să ne direcționeze către formularul lor de contact online pentru a face cererea. Acest lucru nu a susținut dimensiunea documentelor pe care trebuia să le partajăm. Am putut obține e-mailul DPO doar după e-mailuri repetate care explică problema.